scikit-learn - ROC-кривая с доверительными интервалами

Я могу получить кривую ROC, используя scikit-learn сfpr, tpr, thresholds = metrics.roc_curve(y_true,y_pred, pos_label=1), где y_true это список значений на основе моего золотого стандарта (то есть, 0 для отрицательных и 1 для положительных случаев) и y_pred соответствующий список баллов (например, 0.053497243, 0.008521122, 0.022781548, 0.101885263, 0.012913795, 0.0, 0.042881547 [...])

Я пытаюсь выяснить, как добавить доверительные интервалы к этой кривой, но не нашел простого способа сделать это с помощью sklearn.

2 ответа

Вы можете запустить расчеты roc (пример с заменой новых версий y_true / y_pred из оригинала y_true / y_pred и пересчитать новое значение для roc_curve каждый раз) и оценить доверительный интервал таким образом.

Чтобы учесть изменчивость, вызванную разделением теста поезда, вы также можете многократно использовать итератор CV ShuffleSplit, подгонять модель к разделению поезда, генерировать y_pred для каждой модели и, таким образом, собрать эмпирическое распределение roc_curve и, наконец, рассчитать доверительные интервалы для тех.

Редактировать: Boostrapping в Python

Вот пример для начальной загрузки оценки ROC AUC из прогнозов одной модели. Я решил перезагрузить ROC AUC, чтобы его было проще использовать в качестве ответа переполнения стека, но вместо этого его можно адаптировать для начальной загрузки всей кривой:

import numpy as np

from scipy.stats import sem

from sklearn.metrics import roc_auc_score

y_pred = np.array([0.21, 0.32, 0.63, 0.35, 0.92, 0.79, 0.82, 0.99, 0.04])

y_true = np.array([0, 1, 0, 0, 1, 1, 0, 1, 0 ])

print("Original ROC area: {:0.3f}".format(roc_auc_score(y_true, y_pred)))

n_bootstraps = 1000

rng_seed = 42 # control reproducibility

bootstrapped_scores = []

rng = np.random.RandomState(rng_seed)

for i in range(n_bootstraps):

# bootstrap by sampling with replacement on the prediction indices

indices = rng.random_integers(0, len(y_pred) - 1, len(y_pred))

if len(np.unique(y_true[indices])) < 2:

# We need at least one positive and one negative sample for ROC AUC

# to be defined: reject the sample

continue

score = roc_auc_score(y_true[indices], y_pred[indices])

bootstrapped_scores.append(score)

print("Bootstrap #{} ROC area: {:0.3f}".format(i + 1, score))

Вы можете видеть, что нам нужно отклонить некоторые недопустимые повторные выборки. Однако для реальных данных со многими прогнозами это очень редкое событие, которое не должно существенно влиять на доверительный интервал (вы можете попытаться изменить rng_seed Проверять).

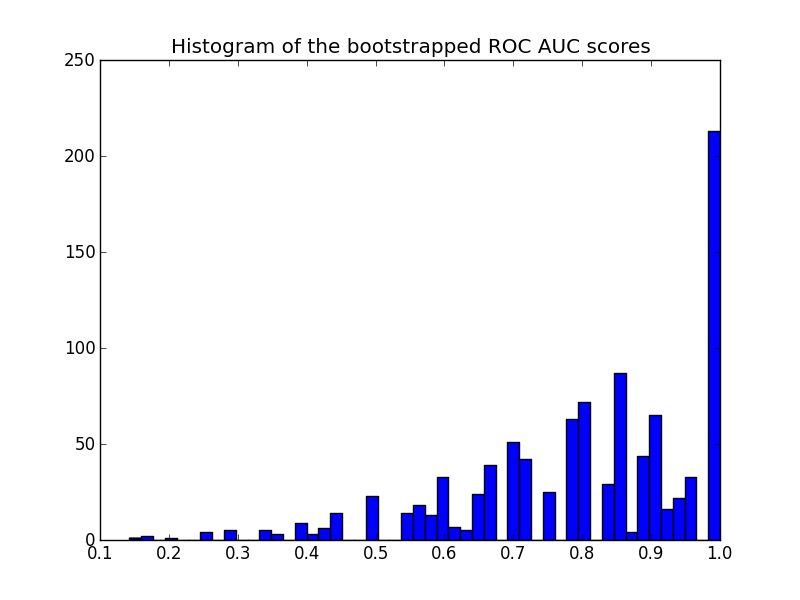

Вот гистограмма:

import matplotlib.pyplot as plt

plt.hist(bootstrapped_scores, bins=50)

plt.title('Histogram of the bootstrapped ROC AUC scores')

plt.show()

Обратите внимание, что пересчитанные оценки подвергаются цензуре в диапазоне [0 - 1], что приводит к большому количеству результатов в последнем бине.

Чтобы получить доверительный интервал, можно отсортировать образцы:

sorted_scores = np.array(bootstrapped_scores)

sorted_scores.sort()

# Computing the lower and upper bound of the 90% confidence interval

# You can change the bounds percentiles to 0.025 and 0.975 to get

# a 95% confidence interval instead.

confidence_lower = sorted_scores[int(0.05 * len(sorted_scores))]

confidence_upper = sorted_scores[int(0.95 * len(sorted_scores))]

print("Confidence interval for the score: [{:0.3f} - {:0.3}]".format(

confidence_lower, confidence_upper))

который дает:

Confidence interval for the score: [0.444 - 1.0]

Доверительный интервал очень широк, но это, вероятно, является следствием моего выбора прогнозов (3 ошибки из 9 прогнозов), а общее количество прогнозов довольно мало.

Еще одно замечание на графике: оценки квантованы (много пустых контейнеров гистограммы). Это является следствием небольшого количества прогнозов. Можно ввести немного гауссовского шума на счетах (или y_pred значения), чтобы сгладить распределение и сделать гистограмму лучше. Но тогда выбор полосы сглаживания сложен.

Наконец, как указывалось ранее, этот доверительный интервал является специфическим для вашего тренировочного набора. Чтобы получить лучшую оценку изменчивости ROC, вызванной вашим классом модели и параметрами, вы должны вместо этого выполнить повторную перекрестную проверку. Однако это часто намного дороже, так как вам нужно обучать новую модель для каждого случайного разделения поезда / теста.

Решение DeLong [НЕТ начальной загрузки]

Как некоторые из здесь предложенных, pROC подход был бы хорош. В соответствии с pROC документация, доверительные интервалы рассчитываются через Делонг:

Делонг - это асимптотически точный метод оценки неопределенности AUC (Делонг и др. (1988)). Начиная с версии 1.9, pROC использует алгоритм, предложенный Sun и Xu (2014), который имеет сложность O(N log N) и всегда быстрее начальной загрузки. По умолчанию pROC будет выбирать метод DeLong, когда это возможно.

В общедоступной репозитории Yandex Data School реализована реализация Fast DeLong:

https://github.com/yandexdataschool/roc_comparison

Таким образом, все кредиты им для реализации DeLong используются в этом примере. Итак, вот как вы получаете КИ через Делонг:

#!/usr/bin/env python3

# -*- coding: utf-8 -*-

"""

Created on Tue Nov 6 10:06:52 2018

@author: yandexdataschool

Original Code found in:

https://github.com/yandexdataschool/roc_comparison

updated: Raul Sanchez-Vazquez

"""

import numpy as np

import scipy.stats

from scipy import stats

# AUC comparison adapted from

# https://github.com/Netflix/vmaf/

def compute_midrank(x):

"""Computes midranks.

Args:

x - a 1D numpy array

Returns:

array of midranks

"""

J = np.argsort(x)

Z = x[J]

N = len(x)

T = np.zeros(N, dtype=np.float)

i = 0

while i < N:

j = i

while j < N and Z[j] == Z[i]:

j += 1

T[i:j] = 0.5*(i + j - 1)

i = j

T2 = np.empty(N, dtype=np.float)

# Note(kazeevn) +1 is due to Python using 0-based indexing

# instead of 1-based in the AUC formula in the paper

T2[J] = T + 1

return T2

def compute_midrank_weight(x, sample_weight):

"""Computes midranks.

Args:

x - a 1D numpy array

Returns:

array of midranks

"""

J = np.argsort(x)

Z = x[J]

cumulative_weight = np.cumsum(sample_weight[J])

N = len(x)

T = np.zeros(N, dtype=np.float)

i = 0

while i < N:

j = i

while j < N and Z[j] == Z[i]:

j += 1

T[i:j] = cumulative_weight[i:j].mean()

i = j

T2 = np.empty(N, dtype=np.float)

T2[J] = T

return T2

def fastDeLong(predictions_sorted_transposed, label_1_count, sample_weight):

if sample_weight is None:

return fastDeLong_no_weights(predictions_sorted_transposed, label_1_count)

else:

return fastDeLong_weights(predictions_sorted_transposed, label_1_count, sample_weight)

def fastDeLong_weights(predictions_sorted_transposed, label_1_count, sample_weight):

"""

The fast version of DeLong's method for computing the covariance of

unadjusted AUC.

Args:

predictions_sorted_transposed: a 2D numpy.array[n_classifiers, n_examples]

sorted such as the examples with label "1" are first

Returns:

(AUC value, DeLong covariance)

Reference:

@article{sun2014fast,

title={Fast Implementation of DeLong's Algorithm for

Comparing the Areas Under Correlated Receiver Oerating Characteristic Curves},

author={Xu Sun and Weichao Xu},

journal={IEEE Signal Processing Letters},

volume={21},

number={11},

pages={1389--1393},

year={2014},

publisher={IEEE}

}

"""

# Short variables are named as they are in the paper

m = label_1_count

n = predictions_sorted_transposed.shape[1] - m

positive_examples = predictions_sorted_transposed[:, :m]

negative_examples = predictions_sorted_transposed[:, m:]

k = predictions_sorted_transposed.shape[0]

tx = np.empty([k, m], dtype=np.float)

ty = np.empty([k, n], dtype=np.float)

tz = np.empty([k, m + n], dtype=np.float)

for r in range(k):

tx[r, :] = compute_midrank_weight(positive_examples[r, :], sample_weight[:m])

ty[r, :] = compute_midrank_weight(negative_examples[r, :], sample_weight[m:])

tz[r, :] = compute_midrank_weight(predictions_sorted_transposed[r, :], sample_weight)

total_positive_weights = sample_weight[:m].sum()

total_negative_weights = sample_weight[m:].sum()

pair_weights = np.dot(sample_weight[:m, np.newaxis], sample_weight[np.newaxis, m:])

total_pair_weights = pair_weights.sum()

aucs = (sample_weight[:m]*(tz[:, :m] - tx)).sum(axis=1) / total_pair_weights

v01 = (tz[:, :m] - tx[:, :]) / total_negative_weights

v10 = 1. - (tz[:, m:] - ty[:, :]) / total_positive_weights

sx = np.cov(v01)

sy = np.cov(v10)

delongcov = sx / m + sy / n

return aucs, delongcov

def fastDeLong_no_weights(predictions_sorted_transposed, label_1_count):

"""

The fast version of DeLong's method for computing the covariance of

unadjusted AUC.

Args:

predictions_sorted_transposed: a 2D numpy.array[n_classifiers, n_examples]

sorted such as the examples with label "1" are first

Returns:

(AUC value, DeLong covariance)

Reference:

@article{sun2014fast,

title={Fast Implementation of DeLong's Algorithm for

Comparing the Areas Under Correlated Receiver Oerating

Characteristic Curves},

author={Xu Sun and Weichao Xu},

journal={IEEE Signal Processing Letters},

volume={21},

number={11},

pages={1389--1393},

year={2014},

publisher={IEEE}

}

"""

# Short variables are named as they are in the paper

m = label_1_count

n = predictions_sorted_transposed.shape[1] - m

positive_examples = predictions_sorted_transposed[:, :m]

negative_examples = predictions_sorted_transposed[:, m:]

k = predictions_sorted_transposed.shape[0]

tx = np.empty([k, m], dtype=np.float)

ty = np.empty([k, n], dtype=np.float)

tz = np.empty([k, m + n], dtype=np.float)

for r in range(k):

tx[r, :] = compute_midrank(positive_examples[r, :])

ty[r, :] = compute_midrank(negative_examples[r, :])

tz[r, :] = compute_midrank(predictions_sorted_transposed[r, :])

aucs = tz[:, :m].sum(axis=1) / m / n - float(m + 1.0) / 2.0 / n

v01 = (tz[:, :m] - tx[:, :]) / n

v10 = 1.0 - (tz[:, m:] - ty[:, :]) / m

sx = np.cov(v01)

sy = np.cov(v10)

delongcov = sx / m + sy / n

return aucs, delongcov

def calc_pvalue(aucs, sigma):

"""Computes log(10) of p-values.

Args:

aucs: 1D array of AUCs

sigma: AUC DeLong covariances

Returns:

log10(pvalue)

"""

l = np.array([[1, -1]])

z = np.abs(np.diff(aucs)) / np.sqrt(np.dot(np.dot(l, sigma), l.T))

return np.log10(2) + scipy.stats.norm.logsf(z, loc=0, scale=1) / np.log(10)

def compute_ground_truth_statistics(ground_truth, sample_weight):

assert np.array_equal(np.unique(ground_truth), [0, 1])

order = (-ground_truth).argsort()

label_1_count = int(ground_truth.sum())

if sample_weight is None:

ordered_sample_weight = None

else:

ordered_sample_weight = sample_weight[order]

return order, label_1_count, ordered_sample_weight

def delong_roc_variance(ground_truth, predictions, sample_weight=None):

"""

Computes ROC AUC variance for a single set of predictions

Args:

ground_truth: np.array of 0 and 1

predictions: np.array of floats of the probability of being class 1

"""

order, label_1_count, ordered_sample_weight = compute_ground_truth_statistics(

ground_truth, sample_weight)

predictions_sorted_transposed = predictions[np.newaxis, order]

aucs, delongcov = fastDeLong(predictions_sorted_transposed, label_1_count, ordered_sample_weight)

assert len(aucs) == 1, "There is a bug in the code, please forward this to the developers"

return aucs[0], delongcov

alpha = .95

y_pred = np.array([0.21, 0.32, 0.63, 0.35, 0.92, 0.79, 0.82, 0.99, 0.04])

y_true = np.array([0, 1, 0, 0, 1, 1, 0, 1, 0 ])

auc, auc_cov = delong_roc_variance(

y_true,

y_pred)

auc_std = np.sqrt(auc_cov)

lower_upper_q = np.abs(np.array([0, 1]) - (1 - alpha) / 2)

ci = stats.norm.ppf(

lower_upper_q,

loc=auc,

scale=auc_std)

ci[ci > 1] = 1

print('AUC:', auc)

print('AUC COV:', auc_cov)

print('95% AUC CI:', ci)

выход:

AUC: 0.8

AUC COV: 0.028749999999999998

95% AUC CI: [0.46767194, 1.]

Я также проверил, что эта реализация соответствует pROC результаты, полученные из R:

library(pROC)

y_true = c(0, 1, 0, 0, 1, 1, 0, 1, 0)

y_pred = c(0.21, 0.32, 0.63, 0.35, 0.92, 0.79, 0.82, 0.99, 0.04)

# Build a ROC object and compute the AUC

roc = roc(y_true, y_pred)

roc

выход:

Call:

roc.default(response = y_true, predictor = y_pred)

Data: y_pred in 5 controls (y_true 0) < 4 cases (y_true 1).

Area under the curve: 0.8

затем

# Compute the Confidence Interval

ci(roc)

выход

95% CI: 0.4677-1 (DeLong)