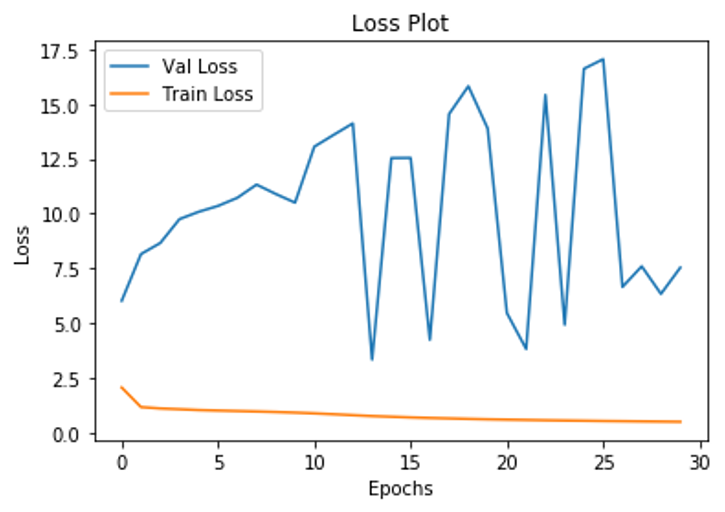

Потеря валидации непоследовательна

У меня есть модель глубокого обучения с подписью к изображениям, она не обучается должным образом. Не знаю, в чем проблема. Я использую кодировщик CNN, BiLSTM-Attention Decoder. Еще я тренировался 100 эпох и т.д., это не улучшило результатов. Показатель Bleu всегда находится в пределах 0,2-0,3.

Я не уверен, является ли это переоснащением или нет. Я испробовал большинство шагов, чтобы не допустить переобучения. У вас есть идеи, как можно улучшить производительность?

Спасибо!

Параметры единицы: 128 размер пакета: 32 размер поезда: 2528 размер проверки: 632 размер теста: 352 скорость обучения: 0,0001 процент отсева: 0,5