Q-обучение в игре не работает должным образом

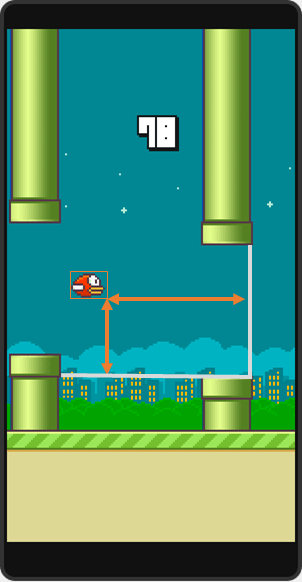

Я попытался внедрить Q-learning в простую игру, которую я написал. Игра основана на том, что игроку приходится "прыгать", чтобы избежать встречных ящиков.

Я разработал систему с двумя действиями; jump а также do_nothing а состояния - это расстояния от следующего блока (разделенные и распределенные по этажам, чтобы не было большого количества состояний).

Похоже, моя проблема заключается в том, что моя реализация алгоритма не учитывает "будущее вознаграждение", и поэтому в итоге он прыгает в неподходящее время.

Вот моя реализация алгоритма Q-обучения;

JumpGameAIClass.prototype.getQ = function getQ(state) {

if (!this.Q.hasOwnProperty(state)) {

this.Q[state] = {};

for (var actionIndex = 0; actionIndex < this.actions.length; actionIndex++) {

var action = this.actions[actionIndex];

this.Q[state][action] = 0;

}

}

return this.Q[state];

};

JumpGameAIClass.prototype.getBlockDistance = function getBlockDistance() {

var closest = -1;

for (var blockIndex = 0; blockIndex < this.blocks.length; blockIndex++) {

var block = this.blocks[blockIndex];

var distance = block.x - this.playerX;

if (distance >= 0 && (closest === -1 || distance < closest)) {

closest = distance;

}

}

return Math.max(0, Math.floor(closest * this.resolution));

};

JumpGameAIClass.prototype.getActionWithHighestQ = function getActionWithHighestQ(distance) {

var jumpReward = this.getQ(distance)[this.actions[0]];

var doNothingReward = this.getQ(distance)[this.actions[1]];

if (jumpReward > doNothingReward) {

return this.actions[0];

} else if (doNothingReward > jumpReward) {

return this.actions[1];

} else {

if (!this.canJump()) {

return this.actions[1];

}

return this.actions[Math.floor(Math.random() * this.actions.length)];

}

};

JumpGameAIClass.prototype.getActionEpsilonGreedy = function getActionEpsilonGreedy() {

// We can't jump while in mid-air

if (!this.canJump()) {

return this.actions[1];

}

if (Math.random() < this.epsilon) {

return this.actions[Math.floor(Math.random() * this.actions.length)];

} else {

return this.getActionWithHighestQ(this.getBlockDistance());

}

};

JumpGameAIClass.prototype.think = function think() {

var reward = this.liveReward;

if (this.score !== this.lastScore) {

this.lastScore = this.score;

reward = this.scoreReward;

} else if (!this.playerAlive) {

reward = this.deathReward;

}

this.drawDistance();

var distance = this.getBlockDistance(),

maxQ = this.getQ(distance)[this.getActionWithHighestQ(distance)],

previousQ = this.getQ(this.lastDistance)[this.lastAction];

this.getQ(this.lastDistance)[this.lastAction] = previousQ + this.alpha * (reward + (this.gamma * maxQ) - previousQ);

this.lastAction = this.getActionEpsilonGreedy();

this.lastDistance = distance;

switch (this.lastAction) {

case this.actions[0]:

this.jump();

break;

}

};

И вот некоторые из свойств, используемых им:

epsilon: 0.05,

alpha: 1,

gamma: 1,

resolution: 0.1,

actions: [ 'jump', 'do_nothing' ],

Q: {},

liveReward: 0,

scoreReward: 100,

deathReward: -1000,

lastAction: 'do_nothing',

lastDistance: 0,

lastScore: 0

Мне нужно использовать lastAction / lastDistance для вычисления Q, так как я не могу использовать текущие данные (будет действовать на действие, выполненное в кадре раньше).

think Метод вызывается один раз за каждый кадр после того, как все рендеринг и игровые вещи сделаны (физика, управление, смерть и т. д.)

var JumpGameAIClass = function JumpGame(canvas) {

Game.JumpGame.call(this, canvas);

Object.defineProperties(this, {

epsilon: {

value: 0.05

},

alpha: {

value: 1

},

gamma: {

value: 1

},

resolution: {

value: 0.1

},

actions: {

value: [ 'jump', 'do_nothing' ]

},

Q: {

value: { },

writable: true

},

liveReward: {

value: 0

},

scoreReward: {

value: 100

},

deathReward: {

value: -1000

},

lastAction: {

value: 'do_nothing',

writable: true

},

lastDistance: {

value: 0,

writable: true

},

lastScore: {

value: 0,

writable: true

}

});

};

JumpGameAIClass.prototype = Object.create(Game.JumpGame.prototype);

JumpGameAIClass.prototype.getQ = function getQ(state) {

if (!this.Q.hasOwnProperty(state)) {

this.Q[state] = {};

for (var actionIndex = 0; actionIndex < this.actions.length; actionIndex++) {

var action = this.actions[actionIndex];

this.Q[state][action] = 0;

}

}

return this.Q[state];

};

JumpGameAIClass.prototype.getBlockDistance = function getBlockDistance() {

var closest = -1;

for (var blockIndex = 0; blockIndex < this.blocks.length; blockIndex++) {

var block = this.blocks[blockIndex];

var distance = block.x - this.playerX;

if (distance >= 0 && (closest === -1 || distance < closest)) {

closest = distance;

}

}

return Math.max(0, Math.floor(closest * this.resolution));

};

JumpGameAIClass.prototype.getActionWithHighestQ = function getActionWithHighestQ(distance) {

var jumpReward = this.getQ(distance)[this.actions[0]];

var doNothingReward = this.getQ(distance)[this.actions[1]];

if (jumpReward > doNothingReward) {

return this.actions[0];

} else if (doNothingReward > jumpReward) {

return this.actions[1];

} else {

if (!this.canJump()) {

return this.actions[1];

}

return this.actions[Math.floor(Math.random() * this.actions.length)];

}

};

JumpGameAIClass.prototype.getActionEpsilonGreedy = function getActionEpsilonGreedy() {

if (!this.canJump()) {

return this.actions[1];

}

if (Math.random() < this.epsilon) {

return this.actions[Math.floor(Math.random() * this.actions.length)];

} else {

return this.getActionWithHighestQ(this.getBlockDistance());

}

};

JumpGameAIClass.prototype.onDeath = function onDeath() {

this.restart();

};

JumpGameAIClass.prototype.think = function think() {

var reward = this.liveReward;

if (this.score !== this.lastScore) {

this.lastScore = this.score;

reward = this.scoreReward;

} else if (!this.playerAlive) {

reward = this.deathReward;

}

this.drawDistance();

var distance = this.getBlockDistance(),

maxQ = this.getQ(distance)[this.getActionWithHighestQ(distance)],

previousQ = this.getQ(this.lastDistance)[this.lastAction];

this.getQ(this.lastDistance)[this.lastAction] = previousQ + this.alpha * (reward + (this.gamma * maxQ) - previousQ);

this.lastAction = this.getActionEpsilonGreedy();

this.lastDistance = distance;

switch (this.lastAction) {

case this.actions[0]:

this.jump();

break;

}

};

JumpGameAIClass.prototype.drawDistance = function drawDistance() {

this.context.save();

this.context.textAlign = 'center';

this.context.textBaseline = 'bottom';

this.context.fillText('Distance: ' + this.getBlockDistance(), this.canvasWidth / 2, this.canvasHeight / 4);

this.context.textBaseline = 'top';

this.context.fillText('Last Distance: ' + this.lastDistance, this.canvasWidth / 2, this.canvasHeight / 4);

this.context.restore();

};

JumpGameAIClass.prototype.onFrame = function onFrame() {

Game.JumpGame.prototype.onFrame.apply(this, arguments);

this.think();

}

Game.JumpGameAI = JumpGameAIClass;body {

background-color: #EEEEEE;

text-align: center;

}

canvas#game {

background-color: #FFFFFF;

border: 1px solid #DDDDDD;

}<!DOCTYPE HTML>

<html lang="en">

<head>

<title>jump</title>

</head>

<body>

<canvas id="game" width="512" height="512">

<h1>Your browser doesn't support canvas!</h1>

</canvas>

<script src="https://raw.githubusercontent.com/cagosta/requestAnimationFrame/master/app/requestAnimationFrame.js"></script>

<!-- https://gist.github.com/jackwilsdon/d06bffa6b32c53321478 -->

<script src="https://cdn.rawgit.com/jackwilsdon/d06bffa6b32c53321478/raw/4e467f82590e76543bf55ff788504e26afc3d694/game.js"></script>

<script src="https://cdn.rawgit.com/jackwilsdon/d06bffa6b32c53321478/raw/2b7ce2c3dd268c4aef9ad27316edb0b235ad0d06/canvasgame.js"></script>

<script src="https://cdn.rawgit.com/jackwilsdon/d06bffa6b32c53321478/raw/2696c72e001e48359a6ce880f1c475613fe359f5/jump.js"></script>

<script src="https://cdn.rawgit.com/jackwilsdon/d06bffa6b32c53321478/raw/249c92f3385757b6edf2ceb49e26f14b89ffdcfe/bootstrap.js"></script>

</body>2 ответа

Вы в основном упростили версию:

Источник: Flappy Bird RL

Я использовал значения:

epsilon: {

value: 0.01

},

alpha: {

value: 0.7

},

gamma: {

value: 0.9

},

resolution: {

value: 0.1

},

liveReward: {

value: 10

},

scoreReward: {

value: -100

},

deathReward: {

value: 1000

},

У него не было проблем с выходом за пределы 100 в первые 20 попыток.

Q-обучение может быть описано с временной логикой

Q(s, a)=r(s,a)+gamma*max_a'(Q(s', a'))

куда

r(s,a)знак равноr= Немедленная наградаgamma= относительная стоимость отсроченных и немедленных вознаграждений (от 0 до 1)s'= новое состояние после действияaa= действие в состоянииsa'= действие в состоянииs'

Вы должны выполнить это как

Выберите действие a и выполните его

- Для каждой пары состояния-действия инициализируйте запись таблицы Q(s, a) в ноль

- Соблюдайте текущее состояние с

- Делай вечно

- Выберите действие a и выполните его

- Получите немедленную награду R aka Q(s, a)

- Соблюдайте новое состояние с '

- Обновить запись таблицы дляQ(s, a)=r(s,a)+ гамма *max_a'(Q(s', a'))

- S = S'

Ваша реализация алгоритма в порядке, просто нужно настроить некоторые параметры.

Если вы назначите некоторое вознаграждение за жизнь, 10 в моем примере и установите для epsilon значение 0, вы получите победный ИИ.

Пример:

var JumpGameAIClass = function JumpGame(canvas) {

Game.JumpGame.call(this, canvas);

Object.defineProperties(this, {

epsilon: {

value: 0

},

alpha: {

value: 1

},

gamma: {

value: 1

},

resolution: {

value: 0.1

},

actions: {

value: [ 'jump', 'do_nothing' ]

},

Q: {

value: { },

writable: true

},

liveReward: {

value: 0

},

scoreReward: {

value: 100

},

deathReward: {

value: -1000

},

lastAction: {

value: 'do_nothing',

writable: true

},

lastDistance: {

value: 0,

writable: true

},

lastScore: {

value: 0,

writable: true

}

});

};

JumpGameAIClass.prototype = Object.create(Game.JumpGame.prototype);

JumpGameAIClass.prototype.getQ = function getQ(state) {

if (!this.Q.hasOwnProperty(state)) {

this.Q[state] = {};

for (var actionIndex = 0; actionIndex < this.actions.length; actionIndex++) {

var action = this.actions[actionIndex];

this.Q[state][action] = 0;

}

}

return this.Q[state];

};

JumpGameAIClass.prototype.getBlockDistance = function getBlockDistance() {

var closest = -1;

for (var blockIndex = 0; blockIndex < this.blocks.length; blockIndex++) {

var block = this.blocks[blockIndex];

var distance = block.x - this.playerX;

if (distance >= 0 && (closest === -1 || distance < closest)) {

closest = distance;

}

}

return Math.max(0, Math.floor(closest * this.resolution));

};

JumpGameAIClass.prototype.getActionWithHighestQ = function getActionWithHighestQ(distance) {

var jumpReward = this.getQ(distance)[this.actions[0]];

var doNothingReward = this.getQ(distance)[this.actions[1]];

if (!this.canJump()) {

return this.actions[1];

} else if (jumpReward > doNothingReward) {

return this.actions[0];

} else if (doNothingReward > jumpReward) {

return this.actions[1];

} else {

return this.actions[Math.floor(Math.random() * this.actions.length)];

}

};

JumpGameAIClass.prototype.getActionEpsilonGreedy = function getActionEpsilonGreedy() {

if (!this.canJump()) {

return this.actions[1];

}

if (Math.random() < this.epsilon) {

return this.actions[Math.floor(Math.random() * this.actions.length)];

} else {

return this.getActionWithHighestQ(this.getBlockDistance());

}

};

JumpGameAIClass.prototype.onDeath = function onDeath() {

this.restart();

};

JumpGameAIClass.prototype.think = function think() {

var reward = this.liveReward;

if (this.score !== this.lastScore) {

this.lastScore = this.score;

reward = this.scoreReward;

} else if (!this.playerAlive) {

reward = this.deathReward;

}

this.drawDistance();

var distance = this.getBlockDistance(),

maxQ = this.playerAlive ? this.getQ(distance)[this.getActionWithHighestQ(distance)] : 0,

previousQ = this.getQ(this.lastDistance)[this.lastAction];

this.getQ(this.lastDistance)[this.lastAction] = previousQ + this.alpha * (reward + (this.gamma * maxQ) - previousQ);

this.lastAction = this.getActionEpsilonGreedy();

this.lastDistance = distance;

switch (this.lastAction) {

case this.actions[0]:

this.jump();

break;

}

};

JumpGameAIClass.prototype.drawDistance = function drawDistance() {

this.context.save();

this.context.textAlign = 'center';

this.context.textBaseline = 'bottom';

this.context.fillText('Distance: ' + this.getBlockDistance(), this.canvasWidth / 2, this.canvasHeight / 4);

this.context.textBaseline = 'top';

this.context.fillText('Last Distance: ' + this.lastDistance, this.canvasWidth / 2, this.canvasHeight / 4);

this.context.restore();

};

JumpGameAIClass.prototype.onFrame = function onFrame() {

Game.JumpGame.prototype.onFrame.apply(this, arguments);

this.think();

}

Game.JumpGameAI = JumpGameAIClass;body {

background-color: #EEEEEE;

text-align: center;

}

canvas#game {

background-color: #FFFFFF;

border: 1px solid #DDDDDD;

}<!DOCTYPE HTML>

<html lang="en">

<head>

<title>jump</title>

</head>

<body>

<canvas id="game" width="512" height="512">

<h1>Your browser doesn't support canvas!</h1>

</canvas>

<script src="https://raw.githubusercontent.com/cagosta/requestAnimationFrame/master/app/requestAnimationFrame.js"></script>

<!-- https://gist.github.com/jackwilsdon/d06bffa6b32c53321478 -->

<script src="https://cdn.rawgit.com/jackwilsdon/d06bffa6b32c53321478/raw/4e467f82590e76543bf55ff788504e26afc3d694/game.js"></script>

<script src="https://cdn.rawgit.com/jackwilsdon/d06bffa6b32c53321478/raw/2b7ce2c3dd268c4aef9ad27316edb0b235ad0d06/canvasgame.js"></script>

<script src="https://cdn.rawgit.com/jackwilsdon/d06bffa6b32c53321478/raw/2696c72e001e48359a6ce880f1c475613fe359f5/jump.js"></script>

<script src="https://cdn.rawgit.com/jackwilsdon/d06bffa6b32c53321478/raw/249c92f3385757b6edf2ceb49e26f14b89ffdcfe/bootstrap.js"></script>

</body>Обновить:

Я немного больше думал об этом, и хотя мой пример, кажется, работает, это не правильно.

Что происходит, так это то, что результат прыжка неизвестен до тех пор, пока в будущем не будет выполнено несколько итераций, назначение немедленной награды за жизнь вызовет повторение любых случайных решений, впервые принятых в каждом состоянии, до конечного результата решения. размножается обратно через штаты.

С физикой игры расстояние прыжка игрока меньше расстояния между блоками, это означает, что прыжок, который очищает блок, приземлится дальше от следующего блока, чем его точка взлета от последнего блока, поэтому такой же прыжок может быть сделан снова. Таким образом, при условии, что перед первым блоком сделан "хороший" переход, система сразу же сойдет к успешному шаблону. Если физика игры была другой или был сделан "плохой" прыжок, этот ИИ может не исправиться.

Проблема в том, что система на самом деле состоит из двух частей: blockDistance и playerY. Без учета состояния игрока в решениях исход прыжка не может быть корректно передан обратно к его началу.

Вы можете обойти это в этой простой игре, склоняя решения не предпринимать никаких действий. Поскольку состояния принятия решений, основанные только на расстоянии, завершены, при условии, что вы не прыгаете, результат не прыжка, то есть смерти, будет правильно распространяться обратно через решения, чтобы не прыгать на каждом расстоянии. Это все еще немного забавно, так как после того, как вы прыгнете, распространение награды не будет правильным, но теперь вы можете видеть, что оно все равно учится.

Пример:

var JumpGameAIClass = function JumpGame(canvas) {

Game.JumpGame.call(this, canvas);

Object.defineProperties(this, {

epsilon: {

value: 0

},

alpha: {

value: 1

},

gamma: {

value: 1

},

resolution: {

value: 0.1

},

actions: {

value: [ 'jump', 'do_nothing' ]

},

Q: {

value: { },

writable: true

},

liveReward: {

value: 10

},

scoreReward: {

value: 100

},

deathReward: {

value: -1000

},

lastAction: {

value: 'do_nothing',

writable: true

},

lastDistance: {

value: 0,

writable: true

},

lastScore: {

value: 0,

writable: true

}

});

};

JumpGameAIClass.prototype = Object.create(Game.JumpGame.prototype);

JumpGameAIClass.prototype.getQ = function getQ(state) {

if (!this.Q.hasOwnProperty(state)) {

this.Q[state] = {};

for (var actionIndex = 0; actionIndex < this.actions.length; actionIndex++) {

var action = this.actions[actionIndex];

this.Q[state][action] = 0;

}

}

return this.Q[state];

};

JumpGameAIClass.prototype.getBlockDistance = function getBlockDistance() {

var closest = -1;

for (var blockIndex = 0; blockIndex < this.blocks.length; blockIndex++) {

var block = this.blocks[blockIndex];

var distance = block.x - this.playerX;

if (distance >= 0 && (closest === -1 || distance < closest)) {

closest = distance;

}

}

return Math.max(0, Math.floor(closest * this.resolution));

};

JumpGameAIClass.prototype.getActionWithHighestQ = function getActionWithHighestQ(distance) {

var jumpReward = this.getQ(distance)[this.actions[0]];

var doNothingReward = this.getQ(distance)[this.actions[1]];

if (!this.canJump() || doNothingReward >= jumpReward) {

return this.actions[1];

} else {

return this.actions[0];

}

};

JumpGameAIClass.prototype.getActionEpsilonGreedy = function getActionEpsilonGreedy() {

if (!this.canJump()) {

return this.actions[1];

}

if (Math.random() < this.epsilon) {

return this.actions[Math.floor(Math.random() * this.actions.length)];

} else {

return this.getActionWithHighestQ(this.getBlockDistance());

}

};

JumpGameAIClass.prototype.onDeath = function onDeath() {

this.restart();

};

JumpGameAIClass.prototype.think = function think() {

var reward = this.liveReward;

if (this.score !== this.lastScore) {

this.lastScore = this.score;

reward = this.scoreReward;

} else if (!this.playerAlive) {

reward = this.deathReward;

}

this.drawDistance();

var distance = this.getBlockDistance(),

maxQ = this.playerAlive ? this.getQ(distance)[this.getActionWithHighestQ(distance)] : 0,

previousQ = this.getQ(this.lastDistance)[this.lastAction];

this.getQ(this.lastDistance)[this.lastAction] = previousQ + this.alpha * (reward + (this.gamma * maxQ) - previousQ);

this.lastAction = this.getActionEpsilonGreedy();

this.lastDistance = distance;

switch (this.lastAction) {

case this.actions[0]:

this.jump();

break;

}

};

JumpGameAIClass.prototype.drawDistance = function drawDistance() {

this.context.save();

this.context.textAlign = 'center';

this.context.textBaseline = 'bottom';

this.context.fillText('Distance: ' + this.getBlockDistance(), this.canvasWidth / 2, this.canvasHeight / 4);

this.context.textBaseline = 'top';

this.context.fillText('Last Distance: ' + this.lastDistance, this.canvasWidth / 2, this.canvasHeight / 4);

this.context.restore();

};

JumpGameAIClass.prototype.onFrame = function onFrame() {

Game.JumpGame.prototype.onFrame.apply(this, arguments);

this.think();

}

Game.JumpGameAI = JumpGameAIClass;body {

background-color: #EEEEEE;

text-align: center;

}

canvas#game {

background-color: #FFFFFF;

border: 1px solid #DDDDDD;

}<!DOCTYPE HTML>

<html lang="en">

<head>

<title>jump</title>

</head>

<body>

<canvas id="game" width="512" height="512">

<h1>Your browser doesn't support canvas!</h1>

</canvas>

<script src="https://raw.githubusercontent.com/cagosta/requestAnimationFrame/master/app/requestAnimationFrame.js"></script>

<!-- https://gist.github.com/jackwilsdon/d06bffa6b32c53321478 -->

<script src="https://cdn.rawgit.com/jackwilsdon/d06bffa6b32c53321478/raw/4e467f82590e76543bf55ff788504e26afc3d694/game.js"></script>

<script src="https://cdn.rawgit.com/jackwilsdon/d06bffa6b32c53321478/raw/2b7ce2c3dd268c4aef9ad27316edb0b235ad0d06/canvasgame.js"></script>

<script src="https://cdn.rawgit.com/jackwilsdon/d06bffa6b32c53321478/raw/2696c72e001e48359a6ce880f1c475613fe359f5/jump.js"></script>

<script src="https://cdn.rawgit.com/jackwilsdon/d06bffa6b32c53321478/raw/249c92f3385757b6edf2ceb49e26f14b89ffdcfe/bootstrap.js"></script>

</body>