Как я могу использовать отношения между совпадениями Фланна, чтобы определить разумную гомографию?

У меня есть панорамное изображение и уменьшенное изображение зданий, видимых на этом панорамном изображении. Что я хочу сделать, так это распознать, находятся ли здания на этом меньшем изображении на этом панорамном изображении, и как выстроились 2 изображения.

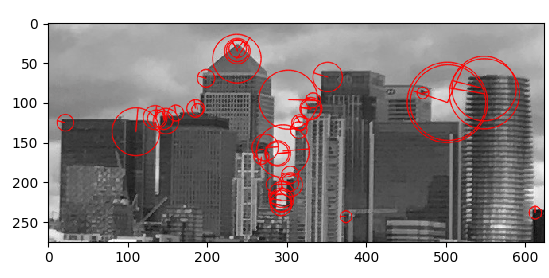

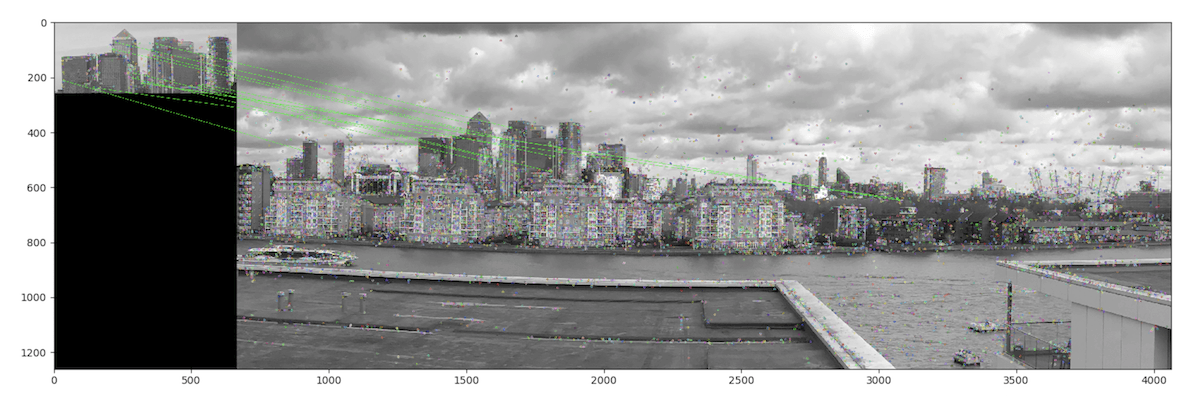

В этом первом примере я использую обрезанную версию моего панорамного изображения, поэтому пиксели идентичны.

import cv2

import matplotlib.pyplot as plt

import matplotlib.image as mpimg

import numpy as np

import math

# Load images

cwImage = cv2.imread('cw1.jpg',0)

panImage = cv2.imread('pan1.jpg',0)

# Prepare for SURF image analysis

surf = cv2.xfeatures2d.SURF_create(4000)

# Find keypoints and point descriptors for both images

cwKeypoints, cwDescriptors = surf.detectAndCompute(cwImage, None)

panKeypoints, panDescriptors = surf.detectAndCompute(panImage, None)

Затем я использую OpenCV FlannBasedMatcher, чтобы найти хорошие совпадения между двумя изображениями:

FLANN_INDEX_KDTREE = 0

index_params = dict(algorithm=FLANN_INDEX_KDTREE, trees=5)

search_params = dict(checks=50)

flann = cv2.FlannBasedMatcher(index_params, search_params)

# Find matches between the descriptors

matches = flann.knnMatch(cwDescriptors, panDescriptors, k=2)

good = []

for m, n in matches:

if m.distance < 0.7 * n.distance:

good.append(m)

Таким образом, вы можете видеть, что в этом примере он идеально соответствует точкам между изображениями. Итак, я нахожу гомографию и применяю перспективный перекос:

cwPoints = np.float32([cwKeypoints[m.queryIdx].pt for m in good

]).reshape(-1, 1, 2)

panPoints = np.float32([panKeypoints[m.trainIdx].pt for m in good

]).reshape(-1, 1, 2)

h, status = cv2.findHomography(cwPoints, panPoints)

warpImage = cv2.warpPerspective(cwImage, h, (panImage.shape[1], panImage.shape[0]))

Результатом является то, что он идеально помещает меньшее изображение в большее изображение.

Теперь я хочу сделать это, когда уменьшенное изображение не является идеальной версией более крупного изображения.

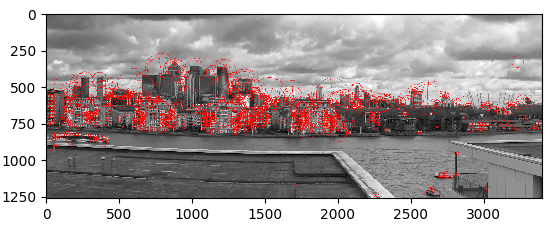

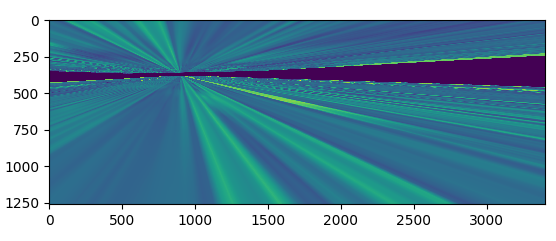

Для нового меньшего изображения ключевые точки выглядят так:

Вы можете видеть, что в некоторых случаях он соответствует правильно, а в некоторых - нет.

Если я позвоню findHomography с этими совпадениями он будет принимать во внимание все эти точки данных и придумывать бессмысленную перспективу деформации, поскольку основывает ее на правильных совпадениях и неправильных совпадениях.

То, что я ищу, - это пропущенный шаг между обнаружением хороших совпадений и вызовом findHomographyгде я могу посмотреть на отношения между совпадениями и определить, какие совпадения, следовательно, являются правильными.

Мне интересно, есть ли в OpenCV функция, на которую я должен обратить внимание на этом шаге, или это то, что мне нужно будет решить самостоятельно, и если да, то как мне это сделать?

1 ответ

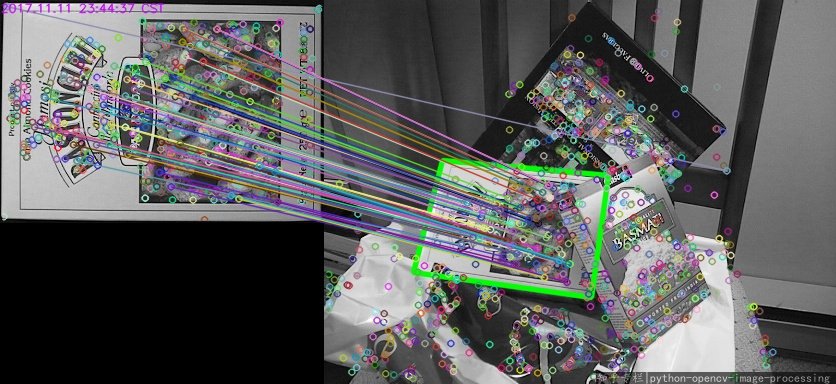

Я написал блог о поиске объекта на сцене в прошлом году ( 2017.11.11). Может быть, это поможет. Вот ссылка. https://zhuanlan.zhihu.com/p/30936804

Конверт: OpenCV 3.3 + Python 3.5

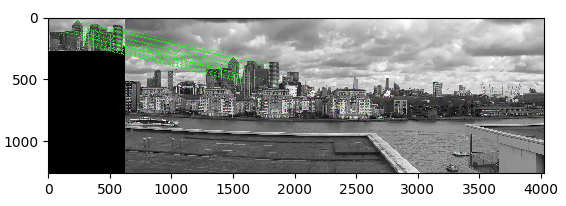

Найдено совпадений:

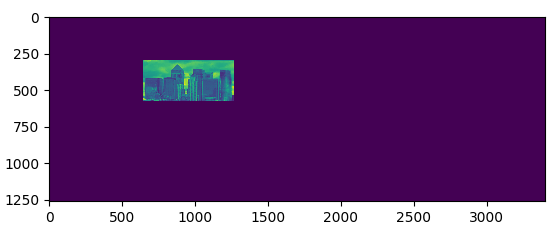

Найденный объект в сцене:

Код:

#!/usr/bin/python3

# 2017.11.11 01:44:37 CST

# 2017.11.12 00:09:14 CST

"""

使用Sift特征点检测和匹配查找场景中特定物体。

"""

import cv2

import numpy as np

MIN_MATCH_COUNT = 4

imgname1 = "box.png"

imgname2 = "box_in_scene.png"

## (1) prepare data

img1 = cv2.imread(imgname1)

img2 = cv2.imread(imgname2)

gray1 = cv2.cvtColor(img1, cv2.COLOR_BGR2GRAY)

gray2 = cv2.cvtColor(img2, cv2.COLOR_BGR2GRAY)

## (2) Create SIFT object

sift = cv2.xfeatures2d.SIFT_create()

## (3) Create flann matcher

matcher = cv2.FlannBasedMatcher(dict(algorithm = 1, trees = 5), {})

## (4) Detect keypoints and compute keypointer descriptors

kpts1, descs1 = sift.detectAndCompute(gray1,None)

kpts2, descs2 = sift.detectAndCompute(gray2,None)

## (5) knnMatch to get Top2

matches = matcher.knnMatch(descs1, descs2, 2)

# Sort by their distance.

matches = sorted(matches, key = lambda x:x[0].distance)

## (6) Ratio test, to get good matches.

good = [m1 for (m1, m2) in matches if m1.distance < 0.7 * m2.distance]

canvas = img2.copy()

## (7) find homography matrix

## 当有足够的健壮匹配点对(至少4个)时

if len(good)>MIN_MATCH_COUNT:

## 从匹配中提取出对应点对

## (queryIndex for the small object, trainIndex for the scene )

src_pts = np.float32([ kpts1[m.queryIdx].pt for m in good ]).reshape(-1,1,2)

dst_pts = np.float32([ kpts2[m.trainIdx].pt for m in good ]).reshape(-1,1,2)

## find homography matrix in cv2.RANSAC using good match points

M, mask = cv2.findHomography(src_pts, dst_pts, cv2.RANSAC,5.0)

## 掩模,用作绘制计算单应性矩阵时用到的点对

#matchesMask2 = mask.ravel().tolist()

## 计算图1的畸变,也就是在图2中的对应的位置。

h,w = img1.shape[:2]

pts = np.float32([ [0,0],[0,h-1],[w-1,h-1],[w-1,0] ]).reshape(-1,1,2)

dst = cv2.perspectiveTransform(pts,M)

## 绘制边框

cv2.polylines(canvas,[np.int32(dst)],True,(0,255,0),3, cv2.LINE_AA)

else:

print( "Not enough matches are found - {}/{}".format(len(good),MIN_MATCH_COUNT))

## (8) drawMatches

matched = cv2.drawMatches(img1,kpts1,canvas,kpts2,good,None)#,**draw_params)

## (9) Crop the matched region from scene

h,w = img1.shape[:2]

pts = np.float32([ [0,0],[0,h-1],[w-1,h-1],[w-1,0] ]).reshape(-1,1,2)

dst = cv2.perspectiveTransform(pts,M)

perspectiveM = cv2.getPerspectiveTransform(np.float32(dst),pts)

found = cv2.warpPerspective(img2,perspectiveM,(w,h))

## (10) save and display

cv2.imwrite("matched.png", matched)

cv2.imwrite("found.png", found)

cv2.imshow("matched", matched);

cv2.imshow("found", found);

cv2.waitKey();cv2.destroyAllWindows()