Проблема ложной зависимости для архитектуры Fermi

Я пытаюсь добиться "3перекрытие "с помощью 3 потоки, как в примерах в потоках CUDA и параллельном вебинаре. Но я не смог этого достичь.

У меня Geforce GT 550M (архитектура Fermi с одним механизмом копирования), и я использую Windows 7 (64-разрядная версия).

Вот код, который я написал.

#include <iostream>

#include "cuda_runtime.h"

#include "device_launch_parameters.h"

// includes, project

#include "helper_cuda.h"

#include "helper_functions.h" // helper utility functions

#include <stdio.h>

using namespace std;

#define DATA_SIZE 6000000

#define NUM_THREADS 32

#define NUM_BLOCKS 16

#define NUM_STREAMS 3

__global__ void kernel(const int *in, int *out, int dataSize)

{

int start = blockIdx.x * blockDim.x + threadIdx.x;

int end = dataSize;

for (int i = start; i < end; i += blockDim.x * gridDim.x)

{

out[i] = in[i] * in[i];

}

}

int main()

{

const int dataSize = DATA_SIZE;

int *h_in = new int[dataSize];

int *h_out = new int[dataSize];

int *h_groundTruth = new int[dataSize];

// Input population

for(int i = 0; i < dataSize; i++)

h_in[i] = 5;

for(int i = 0; i < dataSize; i++)

h_out[i] = 0;

// CPU calculation for ground truth

for(int i = 0; i < dataSize; i++)

h_groundTruth[i] = h_in[i] * h_in[i];

// Choose which GPU to run on, change this on a multi-GPU system.

checkCudaErrors( cudaSetDevice(0) );

int *d_in = 0;

int *d_out = 0;

int streamSize = dataSize / NUM_STREAMS;

size_t memSize = dataSize * sizeof(int);

size_t streamMemSize = memSize / NUM_STREAMS;

checkCudaErrors( cudaMalloc( (void **)&d_in, memSize) );

checkCudaErrors( cudaMalloc( (void **)&d_out, memSize) );

// registers host memory as page-locked (required for asynch cudaMemcpyAsync)

checkCudaErrors(cudaHostRegister(h_in, memSize, cudaHostRegisterPortable));

checkCudaErrors(cudaHostRegister(h_out, memSize, cudaHostRegisterPortable));

// set kernel launch config

dim3 nThreads = dim3(NUM_THREADS,1,1);

dim3 nBlocks = dim3(NUM_BLOCKS,1,1);

cout << "GPU Kernel Configuration : " << endl;

cout << "Number of Streams :\t" << NUM_STREAMS << " with size: \t" << streamSize << endl;

cout << "Number of Threads :\t" << nThreads.x << "\t" << nThreads.y << "\t" << nThreads.z << endl;

cout << "Number of Blocks :\t" << nBlocks.x << "\t" << nBlocks.y << "\t" << nBlocks.z << endl;

// create cuda stream

cudaStream_t streams[NUM_STREAMS];

for(int i = 0; i < NUM_STREAMS; i++)

checkCudaErrors(cudaStreamCreate(&streams[i]));

// create cuda event handles

cudaEvent_t start, stop;

checkCudaErrors(cudaEventCreate(&start));

checkCudaErrors(cudaEventCreate(&stop));

cudaEventRecord(start, 0);

// overlapped execution using version 2

for(int i = 0; i < NUM_STREAMS; i++)

{

int offset = i * streamSize;

cudaMemcpyAsync(&d_in[offset], &h_in[offset], streamMemSize, cudaMemcpyHostToDevice, streams[i]);

}

//cudaMemcpy(d_in, h_in, memSize, cudaMemcpyHostToDevice);

for(int i = 0; i < NUM_STREAMS; i++)

{

int offset = i * streamSize;

dim3 subKernelBlock = dim3((int)ceil((float)nBlocks.x / 2));

//kernel<<<nBlocks, nThreads, 0, streams[i]>>>(&d_in[offset], &d_out[offset], streamSize);

kernel<<<subKernelBlock, nThreads, 0, streams[i]>>>(&d_in[offset], &d_out[offset], streamSize/2);

kernel<<<subKernelBlock, nThreads, 0, streams[i]>>>(&d_in[offset + streamSize/2], &d_out[offset + streamSize/2], streamSize/2);

}

for(int i = 0; i < NUM_STREAMS; i++)

{

int offset = i * streamSize;

cudaMemcpyAsync(&h_out[offset], &d_out[offset], streamMemSize, cudaMemcpyDeviceToHost, streams[i]);

}

for(int i = 0; i < NUM_STREAMS; i++)

checkCudaErrors(cudaStreamSynchronize(streams[i]));

cudaEventRecord(stop, 0);

checkCudaErrors(cudaStreamSynchronize(0));

checkCudaErrors(cudaDeviceSynchronize());

float gpu_time = 0;

checkCudaErrors(cudaEventElapsedTime(&gpu_time, start, stop));

// release resources

checkCudaErrors(cudaEventDestroy(start));

checkCudaErrors(cudaEventDestroy(stop));

checkCudaErrors(cudaHostUnregister(h_in));

checkCudaErrors(cudaHostUnregister(h_out));

checkCudaErrors(cudaFree(d_in));

checkCudaErrors(cudaFree(d_out));

for(int i = 0; i < NUM_STREAMS; i++)

checkCudaErrors(cudaStreamDestroy(streams[i]));

cudaDeviceReset();

cout << "Execution Time of GPU: " << gpu_time << "ms" << endl;

// GPU output check

int sum = 0;

for(int i = 0; i < dataSize; i++)

sum += h_groundTruth[i] - h_out[i];

cout << "Error between CPU and GPU: " << sum << endl;

delete[] h_in;

delete[] h_out;

delete[] h_groundTruth;

return 0;

}

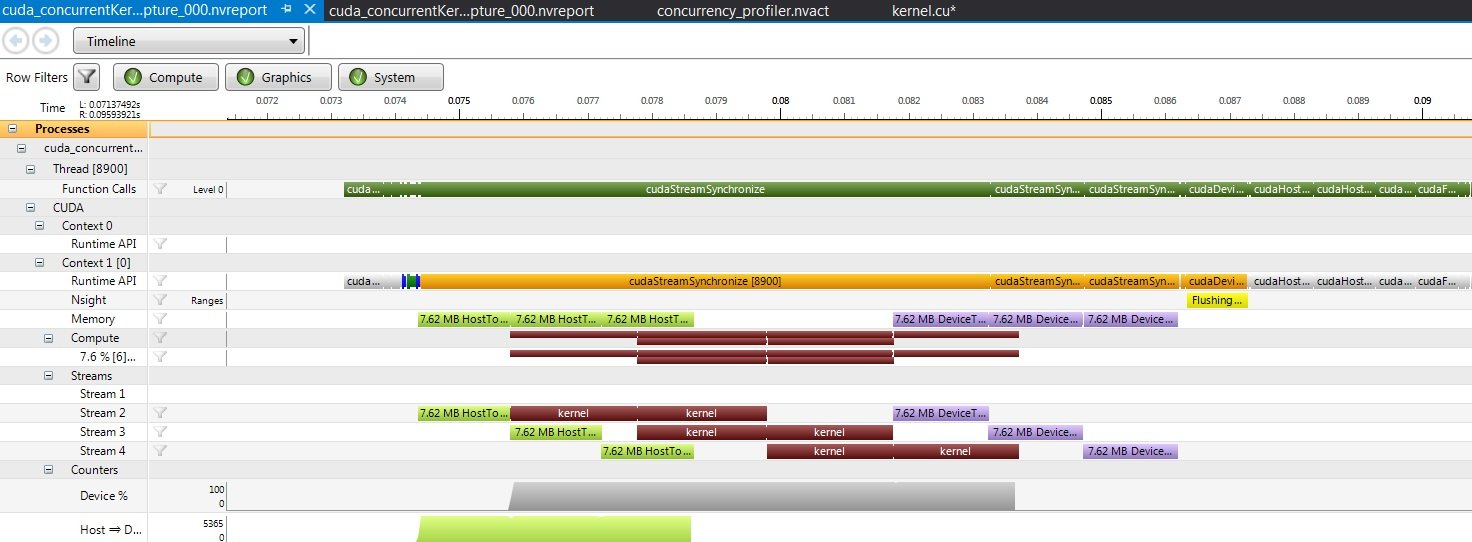

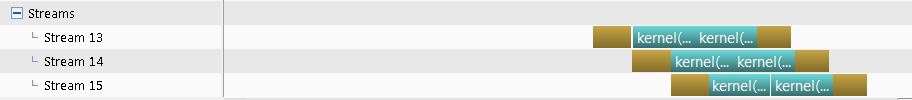

Используя Nsight для профилирования, я получаю такой результат:

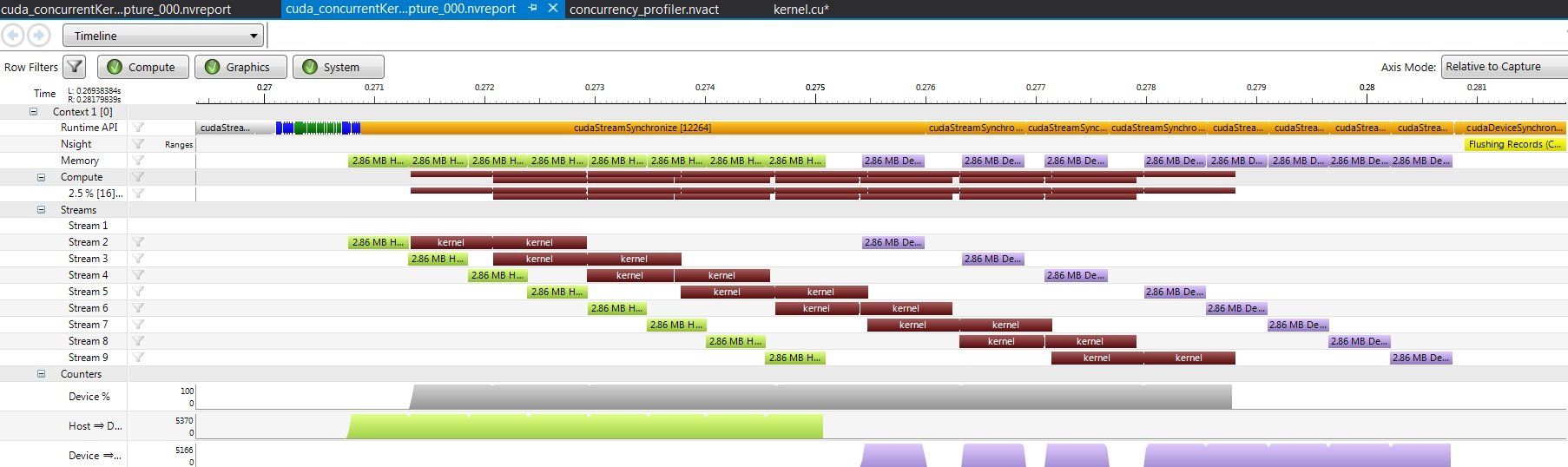

Это может показаться правильным, но почему передача D2H в потоке #1 начинается только при последнем запуске ядра потока #2, а не раньше? Я пытался также использовать 8 потоки (просто путем изменения NUM_STREAM в 8) чтобы достичь такого3-перекрытие "и вот результат:

Интересно то, что когда я использую 8 потоки, перекрытия между вычислениями и передачей памяти, кажется, намного лучше.

В чем причина этой проблемы? Это из-за драйвера WDDM или что-то не так с моей программой?

1 ответ

Из вышеприведенных комментариев кажется, что проблема OP - это проблема ложной зависимости, которая пострадала от архитектуры Fermi и была решена с помощью функции Hyper-Q архитектуры Kepler.

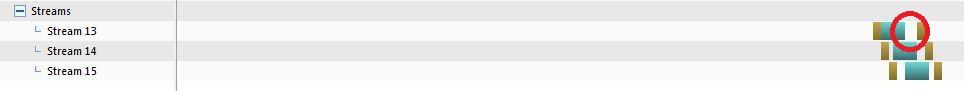

Подводя итог, ОП подчеркивает тот факт, что первая передача D2H (поток #1) не начинается сразу после завершения последней H2D (поток #3), хотя в принципе это возможно. Промежуток времени выделен красным кружком на следующем рисунке (далее, но для указанного иначе все тесты относятся к GeForce GT540M, принадлежащему семейству Fermi):

Подход ФП - это подход в ширину, который работает по следующей схеме:

for(int i = 0; i < NUM_STREAMS; i++)

cudaMemcpyAsync(..., cudaMemcpyHostToDevice, streams[i]);

for(int i = 0; i < NUM_STREAMS; i++)

{

kernel_launch_1<<<..., 0, streams[i]>>>(...);

kernel_launch_2<<<..., 0, streams[i]>>>(...);

}

for(int i = 0; i < NUM_STREAMS; i++)

cudaMemcpyAsync(..., cudaMemcpyDeviceToHost, streams[i]);

Используя подход глубины, работающий по следующей схеме

for(int i = 0; i < NUM_STREAMS; i++)

{

cudaMemcpyAsync(...., cudaMemcpyHostToDevice, streams[i]);

kernel_launch_1<<<...., 0, streams[i]>>>(....);

kernel_launch_2<<<...., 0, streams[i]>>>(....);

cudaMemcpyAsync(...., cudaMemcpyDeviceToHost, streams[i]);

}

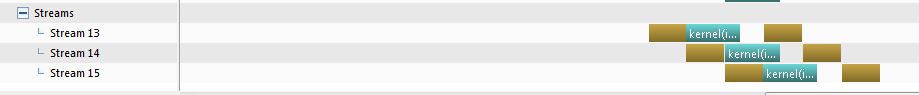

кажется, не улучшит ситуацию, согласно следующей временной шкале (код глубины первый указан в нижней части ответа), но он, кажется, показывает худшее перекрытие:

При подходе в ширину и комментировании запуска второго ядра первая копия D2H запускается немедленно, как только может, как сообщается в следующей временной шкале:

Наконец, при запуске кода на Kepler K20c проблема не обнаруживается, как показано на следующем рисунке:

Вот код для подхода глубины:

#include <iostream>

#include "cuda_runtime.h"

#include "device_launch_parameters.h"

// includes, project

#include "helper_cuda.h"

#include "helper_functions.h" // helper utility functions

#include <stdio.h>

using namespace std;

#define DATA_SIZE 6000000

#define NUM_THREADS 32

#define NUM_BLOCKS 16

#define NUM_STREAMS 3

__global__ void kernel(const int *in, int *out, int dataSize)

{

int start = blockIdx.x * blockDim.x + threadIdx.x;

int end = dataSize;

for (int i = start; i < end; i += blockDim.x * gridDim.x)

{

out[i] = in[i] * in[i];

}

}

int main()

{

const int dataSize = DATA_SIZE;

int *h_in = new int[dataSize];

int *h_out = new int[dataSize];

int *h_groundTruth = new int[dataSize];

// Input population

for(int i = 0; i < dataSize; i++)

h_in[i] = 5;

for(int i = 0; i < dataSize; i++)

h_out[i] = 0;

// CPU calculation for ground truth

for(int i = 0; i < dataSize; i++)

h_groundTruth[i] = h_in[i] * h_in[i];

// Choose which GPU to run on, change this on a multi-GPU system.

checkCudaErrors( cudaSetDevice(0) );

int *d_in = 0;

int *d_out = 0;

int streamSize = dataSize / NUM_STREAMS;

size_t memSize = dataSize * sizeof(int);

size_t streamMemSize = memSize / NUM_STREAMS;

checkCudaErrors( cudaMalloc( (void **)&d_in, memSize) );

checkCudaErrors( cudaMalloc( (void **)&d_out, memSize) );

// registers host memory as page-locked (required for asynch cudaMemcpyAsync)

checkCudaErrors(cudaHostRegister(h_in, memSize, cudaHostRegisterPortable));

checkCudaErrors(cudaHostRegister(h_out, memSize, cudaHostRegisterPortable));

// set kernel launch config

dim3 nThreads = dim3(NUM_THREADS,1,1);

dim3 nBlocks = dim3(NUM_BLOCKS,1,1);

cout << "GPU Kernel Configuration : " << endl;

cout << "Number of Streams :\t" << NUM_STREAMS << " with size: \t" << streamSize << endl;

cout << "Number of Threads :\t" << nThreads.x << "\t" << nThreads.y << "\t" << nThreads.z << endl;

cout << "Number of Blocks :\t" << nBlocks.x << "\t" << nBlocks.y << "\t" << nBlocks.z << endl;

// create cuda stream

cudaStream_t streams[NUM_STREAMS];

for(int i = 0; i < NUM_STREAMS; i++)

checkCudaErrors(cudaStreamCreate(&streams[i]));

// create cuda event handles

cudaEvent_t start, stop;

checkCudaErrors(cudaEventCreate(&start));

checkCudaErrors(cudaEventCreate(&stop));

cudaEventRecord(start, 0);

for(int i = 0; i < NUM_STREAMS; i++)

{

int offset = i * streamSize;

cudaMemcpyAsync(&d_in[offset], &h_in[offset], streamMemSize, cudaMemcpyHostToDevice, streams[i]);

dim3 subKernelBlock = dim3((int)ceil((float)nBlocks.x / 2));

kernel<<<subKernelBlock, nThreads, 0, streams[i]>>>(&d_in[offset], &d_out[offset], streamSize/2);

kernel<<<subKernelBlock, nThreads, 0, streams[i]>>>(&d_in[offset + streamSize/2], &d_out[offset + streamSize/2], streamSize/2);

cudaMemcpyAsync(&h_out[offset], &d_out[offset], streamMemSize, cudaMemcpyDeviceToHost, streams[i]);

}

for(int i = 0; i < NUM_STREAMS; i++)

checkCudaErrors(cudaStreamSynchronize(streams[i]));

cudaEventRecord(stop, 0);

checkCudaErrors(cudaStreamSynchronize(0));

checkCudaErrors(cudaDeviceSynchronize());

float gpu_time = 0;

checkCudaErrors(cudaEventElapsedTime(&gpu_time, start, stop));

// release resources

checkCudaErrors(cudaEventDestroy(start));

checkCudaErrors(cudaEventDestroy(stop));

checkCudaErrors(cudaHostUnregister(h_in));

checkCudaErrors(cudaHostUnregister(h_out));

checkCudaErrors(cudaFree(d_in));

checkCudaErrors(cudaFree(d_out));

for(int i = 0; i < NUM_STREAMS; i++)

checkCudaErrors(cudaStreamDestroy(streams[i]));

cudaDeviceReset();

cout << "Execution Time of GPU: " << gpu_time << "ms" << endl;

// GPU output check

int sum = 0;

for(int i = 0; i < dataSize; i++)

sum += h_groundTruth[i] - h_out[i];

cout << "Error between CPU and GPU: " << sum << endl;

delete[] h_in;

delete[] h_out;

delete[] h_groundTruth;

return 0;

}