Confluent Cloud -> BigQuery - Как диагностировать причину "плохих записей"

Я мог передать данные с сервера MSSql в Topics on Confluent Cloud, но не из тем в BigQuery, выдает ошибку "Плохие записи за последний час - 65"

Я смог подключить темы к bigQuery, но не смог получить данные.

Формат таблицы MSSQL и BigQuery одинаков: первая (строка) последняя (строка) raj ram

Нужно ли мне добавлять какие-либо другие столбцы для приема данных, таких как отметка времени, смещение и т. Д.?

1 ответ

Если есть сообщения, которые нельзя отправить адресату, они будут записаны в очередь недоставленных писем с подробным описанием проблемы.

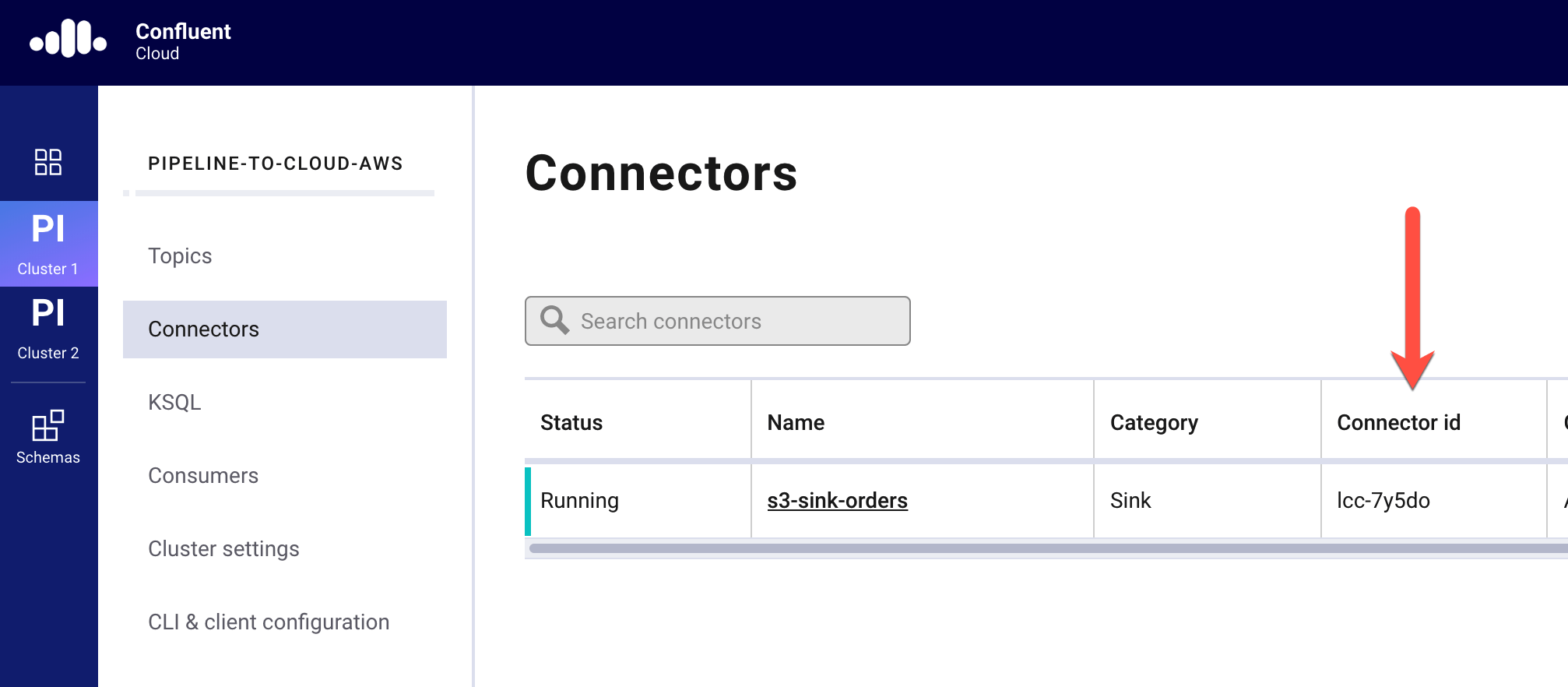

На экране "Коннекторы" вы можете увидеть идентификатор вашего коннектора.

Используйте этот идентификатор, чтобы найти тему с таким же названием и dlq- префикс.

Затем вы можете просмотреть тему и использовать информацию из заголовка, чтобы определить причину проблемы.

Если хотите, вы можете использовать kafkacat для просмотра заголовков:

$ docker run --rm edenhill/kafkacat:1.5.0 \

-X security.protocol=SASL_SSL -X sasl.mechanisms=PLAIN \

-X ssl.ca.location=./etc/ssl/cert.pem -X api.version.request=true \

-b ${CCLOUD_BROKER_HOST} \

-X sasl.username="${CCLOUD_API_KEY}" \

-X sasl.password="${CCLOUD_API_SECRET}" \

-t dlq-lcc-emj3x \

-C -c1 -o beginning \

-f 'Topic %t[%p], offset: %o, Headers: %h'

Topic dlq-lcc-emj3x[0], offset: 12006, Headers: __connect.errors.topic=mysql-01-asgard.demo.transactions,__connect.errors.partition=5,__connect.errors.offset=90,__connect.errors.connector.name=lcc-emj3x,__connect.errors.task.id=0,__connect.errors.stage=VALUE_CONVERTER,__connect.errors.class.name=org.apache.kafka.connect.json.JsonConverter,__connect.errors.exception.class.name=org.apache.kafka.connect.errors.DataException,__connect.errors.exception.message=Converting byte[] to Kafka Connect data failed due to serialization error: ,__connect.errors.exception.stacktrace=org.apache.kafka.connect.errors.DataException: Converting byte[] to Kafka Connect data failed due to serialization error:

at org.apache.kafka.connect.json.JsonConverter.toConnectData(JsonConverter.java:344)

at org.apache.kafka.connect.runtime.WorkerSinkTask.lambda$convertAndTransformRecord$1(WorkerSinkTask.java:487)

at org.apache.kafka.connect.runtime.errors.RetryWithToleranceOperator.execAndRetry(RetryWithToleranceOperator.java:128)

at org.apache.kafka.connect.runtime.errors.RetryWithToleranceOperator.execAndHandleError(RetryWithToleranceOperator.java:162)

at org.apache.kafka.connect.runtime.errors.RetryWithToleranceOperator.execute(RetryWithToleranceOperator.java:104)

at org.apache.kafka.connect.runtime.WorkerSinkTask.convertAndTransformRecord(WorkerSinkTask.java:487)

at org.apache.kafka.connect.runtime.WorkerSinkTask.convertMessages(WorkerSinkTask.java:464)

at org.apache.kafka.connect.runtime.WorkerSinkTask.poll(WorkerSinkTask.java:320)

at org.apache.kafka.connect.runtime.WorkerSinkTask.iteration(WorkerSinkTask.java:224)

at org.apache.kafka.connect.runtime.WorkerSinkTask.execute(WorkerSinkTask.java:192)

at org.apache.kafka.connect.runtime.WorkerTask.doRun(WorkerTask.java:177)

at org.apache.kafka.connect.runtime.WorkerTask.run(WorkerTask.java:227)

at java.base/java.util.concurrent.Executors$RunnableAdapter.call(Executors.java:515)

at java.base/java.util.concurrent.FutureTask.run(FutureTask.java:264)

at java.base/java.util.concurrent.ThreadPoolExecutor.runWorker(ThreadPoolExecutor.java:1128)

at java.base/java.util.concurrent.ThreadPoolExecutor$Worker.run(ThreadPoolExecutor.java:628)

at java.base/java.lang.Thread.run(Thread.java:834)

Caused by: org.apache.kafka.common.errors.SerializationException: com.fasterxml.jackson.core.JsonParseException: Illegal character ((CTRL-CHAR, code 0)): only regular white space (\r, \n, \t) is allowed between tokens

at [Source: (byte[])"

С этого момента это просто случай понимания ошибки. В большинстве случаев это связано с проблемами сериализации, о которых вы можете узнать больше здесь.