импортировать данные таблицы и сохранять как документы json в adls gen2 с помощью блоков данных

Я использую приведенный ниже код для создания набора результатов json из таблицы сервера sql.

Powershell:

$InstanceName = "SQLTEST1\ENG_TST1"

$connectionString = "Server=$InstanceName;Database=dbadb;Integrated Security=True;"

$query = "SELECT * FROM dbo.sales"

$connection = New-Object System.Data.SqlClient.SqlConnection

$connection.ConnectionString = $connectionString

$connection.Open()

$command = $connection.CreateCommand()

$command.CommandText = $query

$result = $command.ExecuteReader()

$table = new-object "System.Data.DataTable"

$table.Load($result)

$table | select $table.Columns.ColumnName | ConvertTo-Json

$connection.Close()

Не могли бы вы посоветовать мне хранить json-документы в Azure Data Lake Storage 2-го поколения с помощью Azure Databricks.

2 ответа

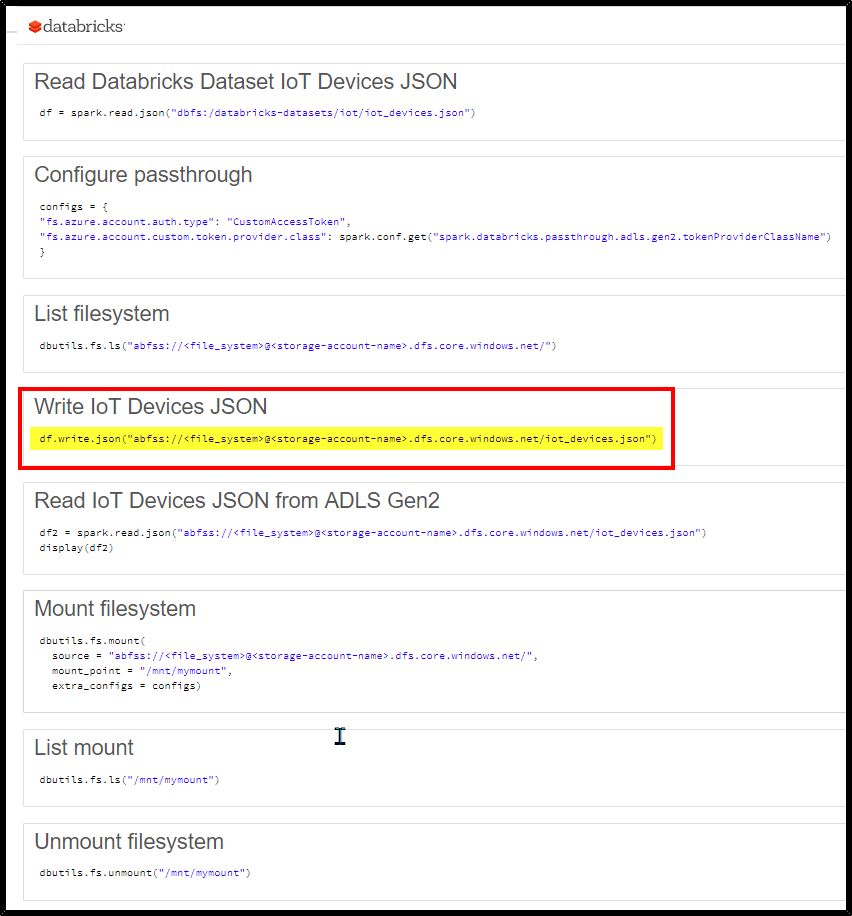

Ты можешь использовать df.write.json API для записи в любое конкретное место в соответствии с вашими потребностями.

Синтаксис:df.write.json('location where you want to save the json file')

Пример:df.write.json("abfss://<file_system>@<storage-account-name>.dfs.core.windows.net/iot_devices.json")

Вот шаги, чтобы сохранить документы JSON в Azure Data Lake Gen2 с помощью Azure Databricks.

Шаг 1: вы можете использоватьspark.read.json API для чтения файла json и создания фрейма данных.

Шаг 2. Место хранения BLOB-объектов можно подключить к каталогу databricks dbfs, используя инструкции в приведенном ниже документе.

https://docs.microsoft.com/en-us/azure/databricks/data/data-sources/azure/azure-datalake-gen2

Шаг 3: Затем используйтеdf.write.json API для записи в точку монтирования, которая будет записывать в хранилище BLOB-объектов

Дополнительные сведения см. В следующих статьях:

Образец записной книжки: https://docs.microsoft.com/en-us/azure/databricks/_static/notebooks/adls-passthrough-gen2.html

Если вы хотите сохранить файл в озере данных Azure Gen2 в Azure databricks, выполните следующие действия.

- Создайте учетную запись Azure Data Lake Storage Gen2.

az login

az storage account create \

--name <account-name> \

--resource-group <group name> \

--location westus \

--sku Standard_RAGRS \

--kind StorageV2 \

--enable-hierarchical-namespace true

- Создайте субъект-службу и назначьте участника службы хранилища BLOB-объектов для sp в области учетной записи хранения Data Lake Storage 2-го поколения.

az login

az ad sp create-for-rbac -n "MyApp" --role "Storage Blob Data Contributor" \

--scopes /subscriptions/<subscription>/resourceGroups/<resource-group>/providers/Microsoft.Storage/storageAccounts/<storage-account>

Создание кластера Spark в Azure Databricks

смонтировать озеро данных Azure Gen2 в Azure databricks(python)

configs = {"fs.azure.account.auth.type": "OAuth",

"fs.azure.account.oauth.provider.type": "org.apache.hadoop.fs.azurebfs.oauth2.ClientCredsTokenProvider",

"fs.azure.account.oauth2.client.id": "<appId>",

"fs.azure.account.oauth2.client.secret": "<clientSecret>",

"fs.azure.account.oauth2.client.endpoint": "https://login.microsoftonline.com/<tenant>/oauth2/token",

"fs.azure.createRemoteFileSystemDuringInitialization": "true"}

dbutils.fs.mount(

source = "abfss://<container-name>@<storage-account-name>.dfs.core.windows.net/folder1",

mount_point = "/mnt/flightdata",

extra_configs = configs)

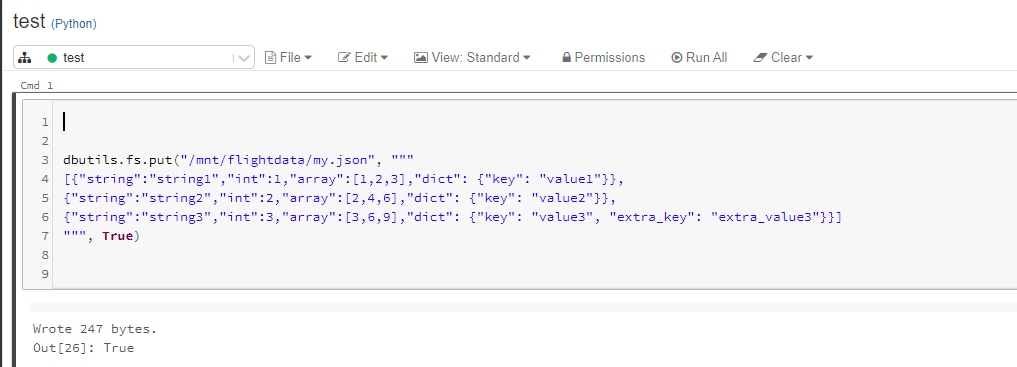

- сохранить json в лазурное озеро данных поколения 2

dbutils.fs.put("/mnt/flightdata/<file name>", """

<json string>

""", True)