MongoDB Kafka Connector не генерирует ключ сообщения с идентификатором документа Mongo

Я использую бета-версию MongoDB Kafka Connector для публикации из MongoDB в теме Kafka.

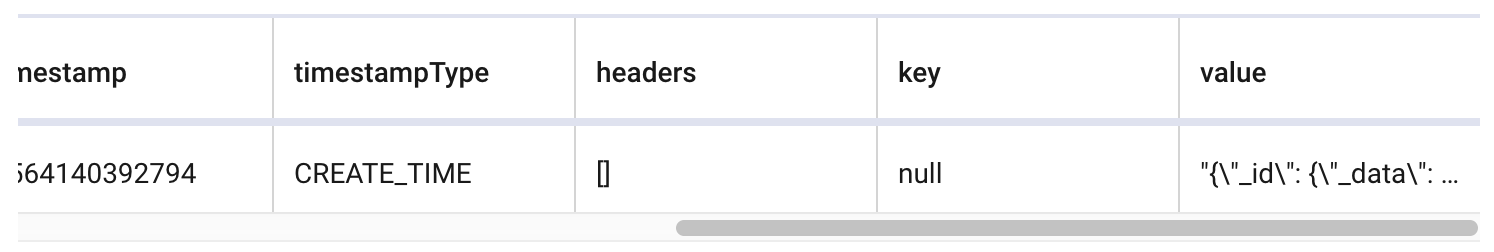

Сообщения генерируются в Kafka, но их ключ равен нулю, когда это должен быть идентификатор документа:

Это мой конфиг автономной конфигурации:

bootstrap.servers=xxx:9092

# The converters specify the format of data in Kafka and how to translate it into Connect data. Every Connect user will

# need to configure these based on the format they want their data in when loaded from or stored into Kafka

key.converter=org.apache.kafka.connect.json.JsonConverter

value.converter=org.apache.kafka.connect.json.JsonConverter

# Converter-specific settings can be passed in by prefixing the Converter's setting with the converter you want to apply

# it to

key.converter.schemas.enable=false

value.converter.schemas.enable=false

# The internal converter used for offsets and config data is configurable and must be specified, but most users will

# always want to use the built-in default. Offset and config data is never visible outside of Kafka Connect in this format.

internal.key.converter=org.apache.kafka.connect.json.JsonConverter

internal.value.converter=org.apache.kafka.connect.json.JsonConverter

internal.key.converter.schemas.enable=false

internal.value.converter.schemas.enable=false

И свойства источника mongodb:

name=mongo-source

connector.class=com.mongodb.kafka.connect.MongoSourceConnector

tasks.max=1

# Connection and source configuration

connection.uri=mongodb+srv://xxx

database=mydb

collection=mycollection

topic.prefix=someprefix

poll.max.batch.size=1000

poll.await.time.ms=5000

# Change stream options

pipeline=[]

batch.size=0

change.stream.full.document=updateLookup

collation=

Ниже приведен пример строкового значения сообщения:

"{\"_id\": {\"_data\": \"xxx\"}, \"operationType\": \"replace\", \"clusterTime\": {\"$timestamp\": {\"t\": 1564140389, \"i\": 1}}, \"fullDocument\": {\"_id\": \"5\", \"name\": \"Some Client\", \"clientId\": \"someclient\", \"clientSecret\": \"1234\", \"whiteListedIps\": [], \"enabled\": true, \"_class\": \"myproject.Client\"}, \"ns\": {\"db\": \"mydb\", \"coll\": \"mycollection\"}, \"documentKey\": {\"_id\": \"5\"}}"

Я попытался использовать преобразование для извлечения, если из значения, в частности, из поля documentKey:

transforms=InsertKey

transforms.InsertKey.type=org.apache.kafka.connect.transforms.ValueToKey

transforms.InsertKey.fields=documentKey

Но есть исключение:

Caused by: org.apache.kafka.connect.errors.DataException: Only Struct objects supported for [copying fields from value to key], found: java.lang.String

at org.apache.kafka.connect.transforms.util.Requirements.requireStruct(Requirements.java:52)

at org.apache.kafka.connect.transforms.ValueToKey.applyWithSchema(ValueToKey.java:79)

at org.apache.kafka.connect.transforms.ValueToKey.apply(ValueToKey.java:65)

Есть идеи для генерации ключа с идентификатором документа?

1 ответ

Согласно исключению, выбрасывается:

Caused by: org.apache.kafka.connect.errors.DataException: Only Struct objects supported for [copying fields from value to key], found: java.lang.String

at org.apache.kafka.connect.transforms.util.Requirements.requireStruct(Requirements.java:52)

at org.apache.kafka.connect.transforms.ValueToKey.applyWithSchema(ValueToKey.java:79)

at org.apache.kafka.connect.transforms.ValueToKey.apply(ValueToKey.java:65)

К сожалению, коннектор Mongo DB, который вы используете, не создает должным образом схему.

Над соединителем создайте запись с ключом и схемой значений как String, Проверьте эту строку:: Как запись создается соединителем. Вот почему вы не можете применить Преобразование к нему

Это должно поддерживаться в версии 1.3.0:https://jira.mongodb.org/browse/KAFKA-40.