PyArrow: хранить список диктов в паркете, используя вложенные типы

Я хочу сохранить следующий кадр данных pandas в файле паркета с помощью PyArrow:

import pandas as pd

df = pd.DataFrame({'field': [[{}, {}]]})

Тип field столбец - список диктовок:

field

0 [{}, {}]

Сначала я определяю соответствующую схему PyArrow:

import pyarrow as pa

schema = pa.schema([pa.field('field', pa.list_(pa.struct([])))])

Тогда я использую from_pandas():

table = pa.Table.from_pandas(df, schema=schema, preserve_index=False)

Это вызывает следующее исключение:

Traceback (most recent call last):

File "<stdin>", line 1, in <module>

File "table.pxi", line 930, in pyarrow.lib.Table.from_pandas

File "/anaconda3/lib/python3.6/site-packages/pyarrow/pandas_compat.py", line 371, in dataframe_to_arrays

convert_types)]

File "/anaconda3/lib/python3.6/site-packages/pyarrow/pandas_compat.py", line 370, in <listcomp>

for c, t in zip(columns_to_convert,

File "/anaconda3/lib/python3.6/site-packages/pyarrow/pandas_compat.py", line 366, in convert_column

return pa.array(col, from_pandas=True, type=ty)

File "array.pxi", line 177, in pyarrow.lib.array

File "error.pxi", line 77, in pyarrow.lib.check_status

File "error.pxi", line 87, in pyarrow.lib.check_status

pyarrow.lib.ArrowTypeError: Unknown list item type: struct<>

Я что-то не так делаю или PyArrow не поддерживается?

Я использую pyarrow 0.9.0, pandas 23.4, python 3.6.

0 ответов

На данный момент использование сочетания списков и структур в качестве типа данных столбца является нереализованной функцией в Apache Arrow (базовой библиотеке для PyArrow). В этом выпуске Jira отслеживается прогресс по теме.

С PyArrow 0.15.0 уже можно создать таблицу pyarrow из фрейма данных pandas с вложенными типами, но невозможно сохранить таблицу в файле parquet (или преобразовать его обратно в фреймворк pandas):

import pandas as pd

import pyarrow as pa

import pyarrow.parquet

df = pd.DataFrame({'field': [[{'a': 1}, {'a': 2}]]})

schema = pa.schema(

[pa.field('field', pa.list_(pa.struct([('a', pa.int64())])))])

table = pa.Table.from_pandas(df, schema=schema, preserve_index=False)

pyarrow.parquet.write_table(table, 'test.parquet')

Traceback (most recent call last):

File "<stdin>", line 1, in <module>

File "/tmp/bla.py", line 11, in <module>

pyarrow.parquet.write_table(table, 'test.parquet')

File "/anaconda3/lib/python3.7/site-packages/pyarrow/parquet.py", line 1344, in write_table

writer.write_table(table, row_group_size=row_group_size)

File "/anaconda3/lib/python3.7/site-packages/pyarrow/parquet.py", line 474, in write_table

self.writer.write_table(table, row_group_size=row_group_size)

File "pyarrow/_parquet.pyx", line 1375, in pyarrow._parquet.ParquetWriter.write_table

File "pyarrow/error.pxi", line 86, in pyarrow.lib.check_status

pyarrow.lib.ArrowNotImplementedError: Level generation for Struct not supported yet

Вот фрагмент для воспроизведения этой ошибки:

#!/usr/bin/env python3

import pandas as pd # type: ignore

def main():

"""Main function"""

df = pd.DataFrame()

df["nested"] = [[dict()] for i in range(10)]

df.to_feather("test.feather")

print("Success once")

df = pd.read_feather("test.feather")

df.to_feather("test.feather")

if __name__ == "__main__":

main()

Обратите внимание, что от панд до пера ничего не ломается, но как только фрейм данных загружается из пера и кто-то пытается записать обратно в него, он ломается.

Чтобы решить эту проблему, просто обновите pyarrow 2.0.0:

pip3 install pyarrow==2.0.0

Доступные версии pyarrow по состоянию на 16.11.2020:

0.9.0, 0.10.0, 0.11.0, 0.11.1, 0.12.0, 0.12.1, 0.13.0, 0.14.0, 0.15.1, 0.16.0, 0.17.0, 0.17.1, 1.0.0, 1.0.1, 2.0.0

Мне удалось сохранить фреймы данных pandas, которые имеют массивы в столбцах как паркет, и прочитать их обратно с паркета в фреймы данных, преобразовав dtypes фреймов данных объекта в str.

def mapTypes(x):

return {'object': 'str', 'int64': 'int64', 'float64': 'float64', 'bool': 'bool',

'datetime64[ns, ' + timezone + ']': 'datetime64[ns, ' + timezone + ']'}.get(x,"str") # string is default if type not mapped

table_names = [x for x in df.columns]

table_types = [mapTypes(x.name) for x in df.dtypes]

parquet_table = dict(zip(table_names, table_types))

df_pq = df.astype(parquet_table)

import awswrangler as wr

wr.s3.to_parquet(df=df_pq,path=path,dataset=True,database='test',mode='overwrite',table=table.lower(),partition_cols=['realmid'],sanitize_columns=True)

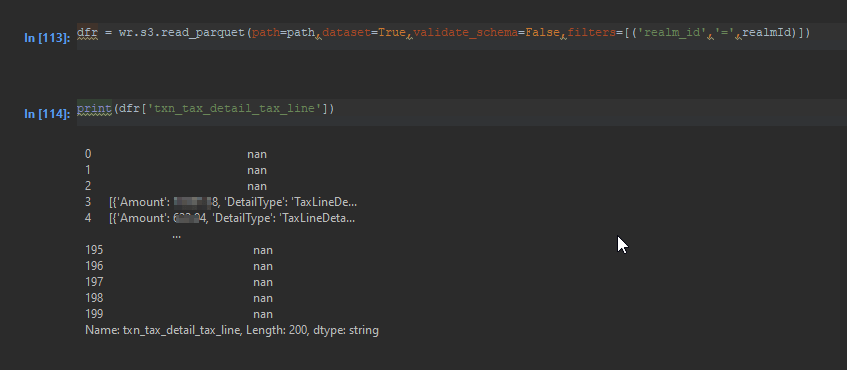

На рисунке ниже показано чтение из паркетного файла, хранящегося в s3, в фрейм данных с использованием библиотеки AWS datawrangler, я также сделал это с помощью pyarrow