Как интерпретировать вывод profr::profr?

Редактировать:

оба они кажутся актуальными: как эффективно использовать Rprof в R? и вычисление матрицы ядра вне обучения SVM в Kernlab

Первый из вышеперечисленных вопросов очень похож на этот, хотя и не тот. Этот вопрос относится к base::Rprof, Этот вопрос относится к profr::profr,

Оригинальный вопрос

Например, мой код работает медленнее, чем хотелось бы:

install.packages("profr")

devtools::install_github("alexwhitworth/imputation")

x <- matrix(rnorm(1000), 100)

x[x>1] <- NA

library(imputation)

library(profr)

a <- profr(kNN_impute(x, k=5, q=2), interval= 0.005)

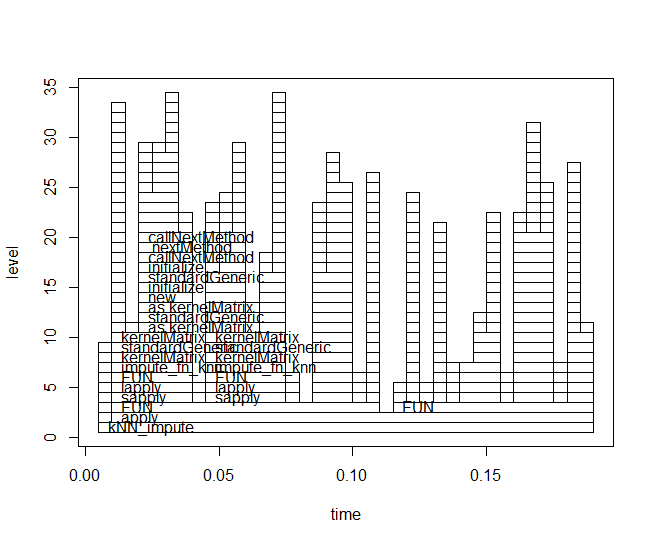

plot(a)

Каждый раз, когда я запускаю этот код, я получаю немного разные графики из-за стохастической природы профилирования, но в целом они похожи. Но я не знаю, как интерпретировать сюжеты.

Я также пытался использовать library(lineprof) после Adv-R и так же не смог интерпретировать сюжеты.

Любая помощь приветствуется.

Кроме того, это не кажется (по крайней мере, мне), что заговоры вообще полезны здесь. Но сама структура данных, кажется, предлагает решение:

R> head(a, 10)

level g_id t_id f start end n leaf time source

9 1 1 1 kNN_impute 0.005 0.190 1 FALSE 0.185 imputation

10 2 1 1 var_tests 0.005 0.010 1 FALSE 0.005 <NA>

11 2 2 1 apply 0.010 0.190 1 FALSE 0.180 base

12 3 1 1 var.test 0.005 0.010 1 FALSE 0.005 stats

13 3 2 1 FUN 0.010 0.110 1 FALSE 0.100 <NA>

14 3 2 2 FUN 0.115 0.190 1 FALSE 0.075 <NA>

15 4 1 1 var.test.default 0.005 0.010 1 FALSE 0.005 <NA>

16 4 2 1 sapply 0.010 0.040 1 FALSE 0.030 base

17 4 3 1 dist_q.matrix 0.040 0.045 1 FALSE 0.005 imputation

18 4 4 1 sapply 0.045 0.075 1 FALSE 0.030 base

1 ответ

Как упоминалось выше, структура данных сама по себе предлагает ответ, который заключается в суммировании данных по функциям с помощью tapply, Это можно сделать довольно просто за один проход profr::profr

t <- tapply(a$time, paste(a$source, a$f, sep= "::"), sum)

t[order(t)] # time / function

R> round(t[order(t)] / sum(t), 4) # percentage of total time / function

base::! base::%in% base::| base::anyDuplicated

0.0015 0.0015 0.0015 0.0015

base::c base::deparse base::get base::match

0.0015 0.0015 0.0015 0.0015

base::mget base::min base::t methods::el

0.0015 0.0015 0.0015 0.0015

methods::getGeneric NA::.findMethodInTable NA::.getGeneric NA::.getGenericFromCache

0.0015 0.0015 0.0015 0.0015

NA::.getGenericFromCacheTable NA::.identC NA::.newSignature NA::.quickCoerceSelect

0.0015 0.0015 0.0015 0.0015

NA::.sigLabel NA::var.test.default NA::var_tests stats::var.test

0.0015 0.0015 0.0015 0.0015

base::paste methods::as<- NA::.findInheritedMethods NA::.getClassFromCache

0.0030 0.0030 0.0030 0.0030

NA::doTryCatch NA::tryCatchList NA::tryCatchOne base::crossprod

0.0030 0.0030 0.0030 0.0045

base::try base::tryCatch methods::getClassDef methods::possibleExtends

0.0045 0.0045 0.0045 0.0045

methods::loadMethod methods::is imputation::dist_q.matrix methods::validObject

0.0075 0.0090 0.0120 0.0136

NA::.findNextFromTable methods::addNextMethod NA::.nextMethod base::lapply

0.0166 0.0346 0.0361 0.0392

base::sapply imputation::impute_fn_knn methods::new imputation::kNN_impute

0.0392 0.0392 0.0437 0.0557

methods::callNextMethod kernlab::as.kernelMatrix base::apply kernlab::kernelMatrix

0.0572 0.0633 0.0663 0.0753

methods::initialize NA::FUN base::standardGeneric

0.0798 0.0994 0.1325

Из этого я вижу, что самые большие пользователи времени kernlab::kernelMatrix и накладные расходы от R для классов S4 и дженериков.

Предпочтительно:

Я отмечаю, что, учитывая стохастический характер процесса выборки, я предпочитаю использовать средние значения, чтобы получить более надежную картину временного профиля:

prof_list <- replicate(100, profr(kNN_impute(x, k=5, q=2),

interval= 0.005), simplify = FALSE)

fun_timing <- vector("list", length= 100)

for (i in 1:100) {

fun_timing[[i]] <- tapply(prof_list[[i]]$time, paste(prof_list[[i]]$source, prof_list[[i]]$f, sep= "::"), sum)

}

# Here is where the stochastic nature of the profiler complicates things.

# Because of randomness, each replication may have slightly different

# functions called during profiling

sapply(fun_timing, function(x) {length(names(x))})

# we can also see some clearly odd replications (at least in my attempt)

> sapply(fun_timing, sum)

[1] 2.820 5.605 2.325 2.895 3.195 2.695 2.495 2.315 2.005 2.475 4.110 2.705 2.180 2.760

[15] 3130.240 3.435 7.675 7.155 5.205 3.760 7.335 7.545 8.155 8.175 6.965 5.820 8.760 7.345

[29] 9.815 7.965 6.370 4.900 5.720 4.530 6.220 3.345 4.055 3.170 3.725 7.780 7.090 7.670

[43] 5.400 7.635 7.125 6.905 6.545 6.855 7.185 7.610 2.965 3.865 3.875 3.480 7.770 7.055

[57] 8.870 8.940 10.130 9.730 5.205 5.645 3.045 2.535 2.675 2.695 2.730 2.555 2.675 2.270

[71] 9.515 4.700 7.270 2.950 6.630 8.370 9.070 7.950 3.250 4.405 3.475 6.420 2948.265 3.470

[85] 3.320 3.640 2.855 3.315 2.560 2.355 2.300 2.685 2.855 2.540 2.480 2.570 3.345 2.145

[99] 2.620 3.650

Удаление необычных копий и преобразование в data.frame s:

fun_timing <- fun_timing[-c(15,83)]

fun_timing2 <- lapply(fun_timing, function(x) {

ret <- data.frame(fun= names(x), time= x)

dimnames(ret)[[1]] <- 1:nrow(ret)

return(ret)

})

Объединить репликации (почти наверняка может быть быстрее) и изучить результаты:

# function for merging DF's in a list

merge_recursive <- function(list, ...) {

n <- length(list)

df <- data.frame(list[[1]])

for (i in 2:n) {

df <- merge(df, list[[i]], ... = ...)

}

return(df)

}

# merge

fun_time <- merge_recursive(fun_timing2, by= "fun", all= FALSE)

# do some munging

fun_time2 <- data.frame(fun=fun_time[,1], avg_time=apply(fun_time[,-1], 1, mean, na.rm=T))

fun_time2$avg_pct <- fun_time2$avg_time / sum(fun_time2$avg_time)

fun_time2 <- fun_time2[order(fun_time2$avg_time, decreasing=TRUE),]

# examine results

R> head(fun_time2, 15)

fun avg_time avg_pct

4 base::standardGeneric 0.6760714 0.14745123

20 NA::FUN 0.4666327 0.10177262

12 methods::initialize 0.4488776 0.09790023

9 kernlab::kernelMatrix 0.3522449 0.07682464

8 kernlab::as.kernelMatrix 0.3215816 0.07013698

11 methods::callNextMethod 0.2986224 0.06512958

1 base::apply 0.2893367 0.06310437

7 imputation::kNN_impute 0.2433163 0.05306731

14 methods::new 0.2309184 0.05036331

10 methods::addNextMethod 0.2012245 0.04388708

3 base::sapply 0.1875000 0.04089377

2 base::lapply 0.1865306 0.04068234

6 imputation::impute_fn_knn 0.1827551 0.03985890

19 NA::.nextMethod 0.1790816 0.03905772

18 NA::.findNextFromTable 0.1003571 0.02188790

Результаты

Из результатов получается похожая, но более надежная картина, как в случае с одним случаем. А именно, есть много накладных расходов от R, а также что library(kernlab) замедляет меня Примечательно, что с kernlab реализован в S4, служебная нагрузка в R связана с тем, что классы S4 существенно медленнее, чем классы S3.

Я также хотел бы отметить, что мое личное мнение состоит в том, что очищенная версия этого может быть полезным пул- запросом в качестве сводного метода для profr. Хотя мне было бы интересно увидеть предложения других!